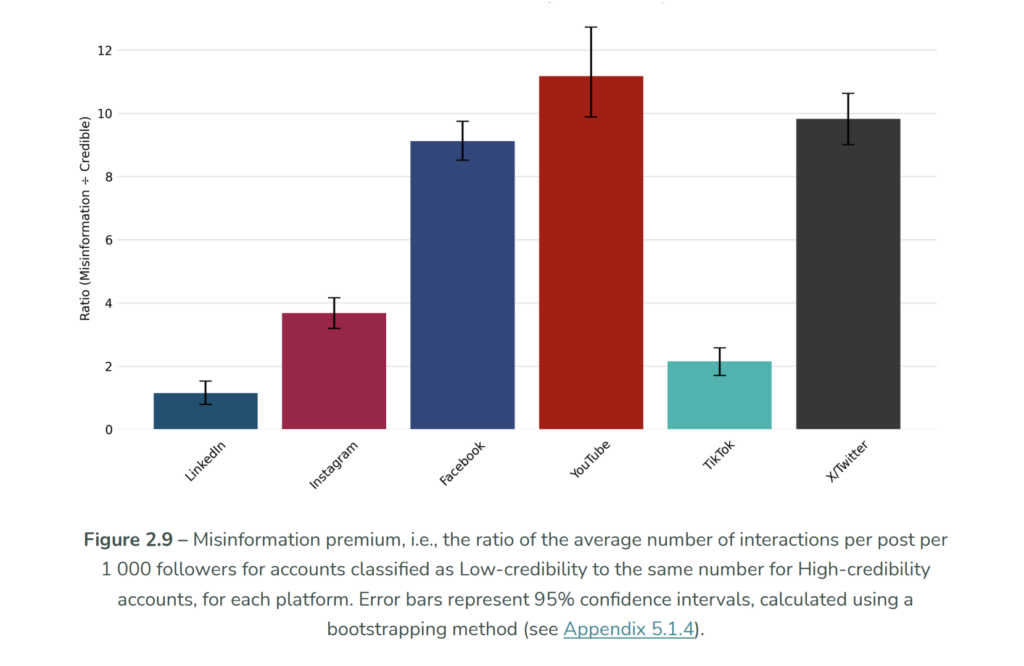

Sur YouTube, un compte qui diffuse régulièrement des informations fausses génère désormais onze fois plus d’interactions par publication qu’une source crédible de taille comparable. Sur X/Twitter, ce ratio atteint dix fois plus. Ces chiffres issus du second rapport SIMODS, publié le 19 mars 2026, confirment et aggravent ce que la première vague avait déjà documenté six mois plus tôt. La désinformation sur les réseaux sociaux ne prolifère pas malgré les plateformes. Elle prospère, en partie, grâce à elles. Explications.

En bref – ce que dit le rapport SIMODS 2 (2026) :

- TikTok : 25 % de contenus trompeurs (contre 20% en 2025)

- Prime à la désinformation : x10 sur X/Twitter, x11 sur YouTube

- 24% de la désinformation sur TikTok contient des éléments générés par IA

- Seulement 16,5% de ces contenus IA sont étiquetés comme tels

- LinkedIn : seule plateforme sans prime à la désinformation significative

Le projet SIMODS (pour Structural Indicators to Monitor Online Disinformation Scientifically) est conduit par un consortium européen piloté par Science Feedback, en partenariat avec Newtral, Demagog SK, Pravda, Check First et l’Universitat Oberta de Catalunya. Son ambition : produire des mesures indépendantes, comparables et reproductibles de la désinformation sur les grandes plateformes numériques européennes.

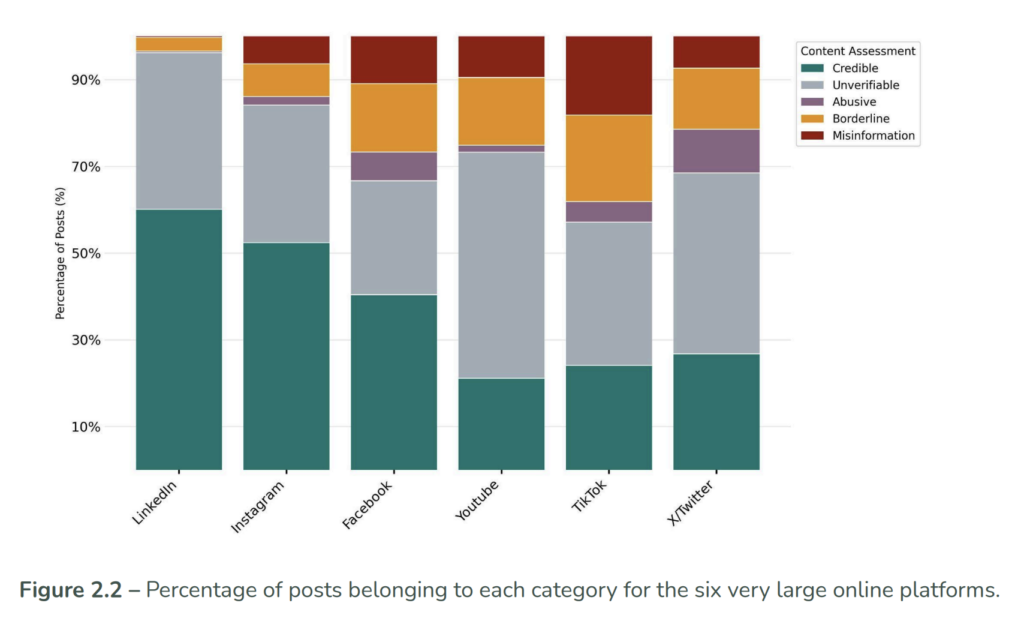

La seconde vague, dont les données ont été collectées en octobre 2025, porte sur 3,3 millions de publications représentant 18 milliards de vues, réparties sur six plateformes – Facebook, Instagram, LinkedIn, TikTok, X/Twitter et YouTube – dans quatre pays : la France, l’Espagne, la Pologne et la Slovaquie. Sur chaque plateforme et dans chaque pays, 500 publications ont été tirées au sort selon un échantillonnage pondéré par les vues, puis annotées par des fact-checkers professionnels.

Ce qui distingue fondamentalement cette vague par rapport à la première, que j’avais déjà analysée, c’est la possibilité de comparer. Deux mesures indépendantes, même méthodologie, résultats cohérents. Et, malheureusement oui, les plateformes ont encore augmenté la prime à la désinformation.

Aggravation de l’amplification algorithmique de la désinformation

Cette notion de « prime à la désinformation » désigne le rapport entre l’engagement moyen par publication des comptes peu crédibles et celui des comptes de haute crédibilité à audience comparable. C’est un indicateur direct de la manière dont les algorithmes amplifient, ou non, les contenus trompeurs par rapport aux sources fiables.

Sur YouTube, cette prime est passée d’environ 8,5 à 11 entre les deux vagues. Sur X/Twitter, elle a bondi de 4 à 10. Sur Facebook, elle se situe autour de 9. Instagram et TikTok affichent des ratios plus modérés, respectivement 4 et 2, mais toujours significatifs.

Pour mettre ces chiffres en perspective : à nombre d’abonnés équivalent, un compte qui diffuse régulièrement des informations fausses sur YouTube génère onze fois plus de likes, de commentaires et de partages qu’une source journalistique ou scientifique.

Ce différentiel n’est pas le fruit du hasard. Il reflète le fonctionnement des systèmes de recommandation, conçus pour maximiser l’engagement. Et la désinformation, par son caractère émotionnel et clivant, en profite structurellement.

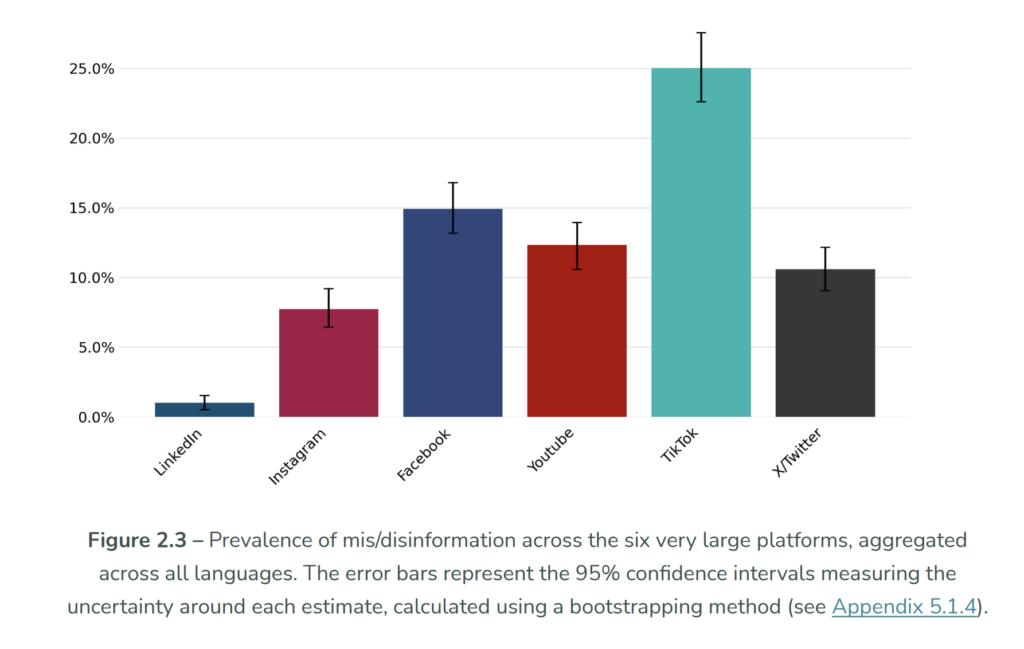

Des chiffres en hausse entre 2025 et 2026

Sur le plan de la prévalence, voici l’évolution entre les deux vagues de mesure :

| Plateforme | Prévalence vague 1 (2025) | Prévalence vague 2 (2026) |

|---|---|---|

| TikTok | ~20% | ~25% |

| ~13% | ~15% | |

| YouTube | ~8,5% | ~12% |

| X/Twitter | ~10,5% | ~11% |

| ~8% | ~8% | |

| ~2% | ~1% |

Trois plateformes (TikTok, X/Twitter et YouTube) affichent désormais plus de contenus problématiques que de contenus crédibles dans les échantillons analysés. Lors de la première vague, seul X/Twitter (et son biais politique majeur et son crash de modération) était dans ce cas.

Intelligence artificielle et désinformation : un cocktail explosif et peu étiqueté

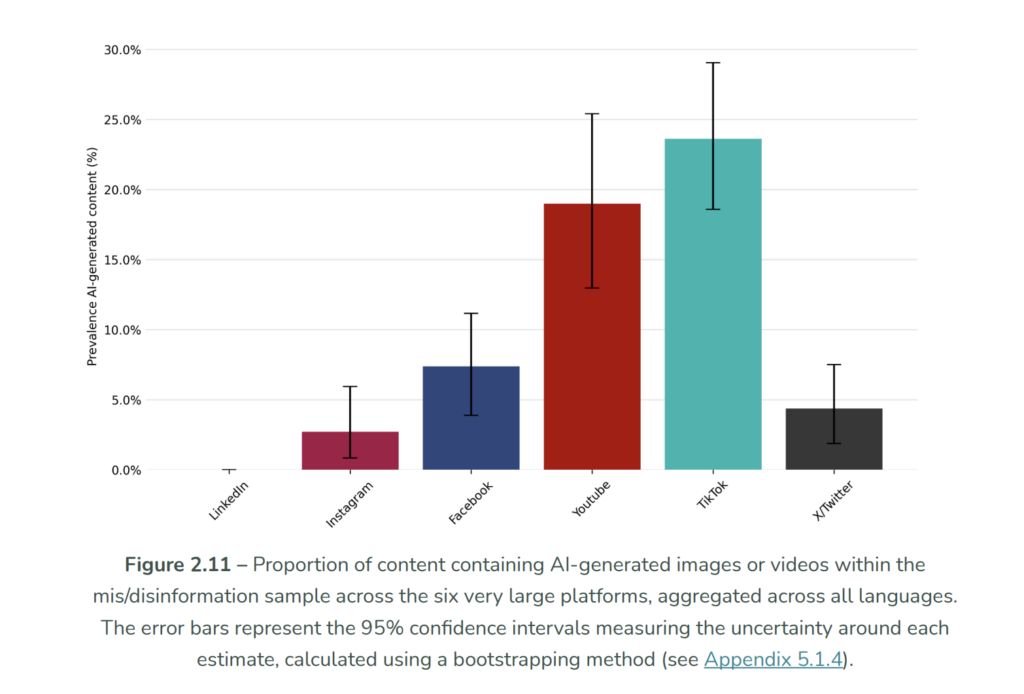

La vague 2 introduit par ailleurs un indicateur inédit : la part de la désinformation identifiée qui contient des éléments générés par intelligence artificielle.

Les résultats sont frappants. Sur TikTok, 24% des contenus trompeurs identifiés contiennent des éléments générés par IA. Sur YouTube, ce chiffre atteint 19%. Ces deux plateformes, exclusivement vidéo, sont logiquement les plus exposées. Facebook suit à 7%, tandis que X/Twitter et Instagram affichent des proportions plus faibles, respectivement 4,4% et 2,6%.

Ce qui aggrave le problème, c’est l’absence quasi-totale d’étiquetage. Sur l’ensemble des contenus trompeurs générés par IA identifiés dans l’étude, seulement 16,5% portaient une mention visible indiquant leur nature synthétique. Sur Facebook, ce taux tombe à 1,8%. Sur YouTube, à 0,9%.

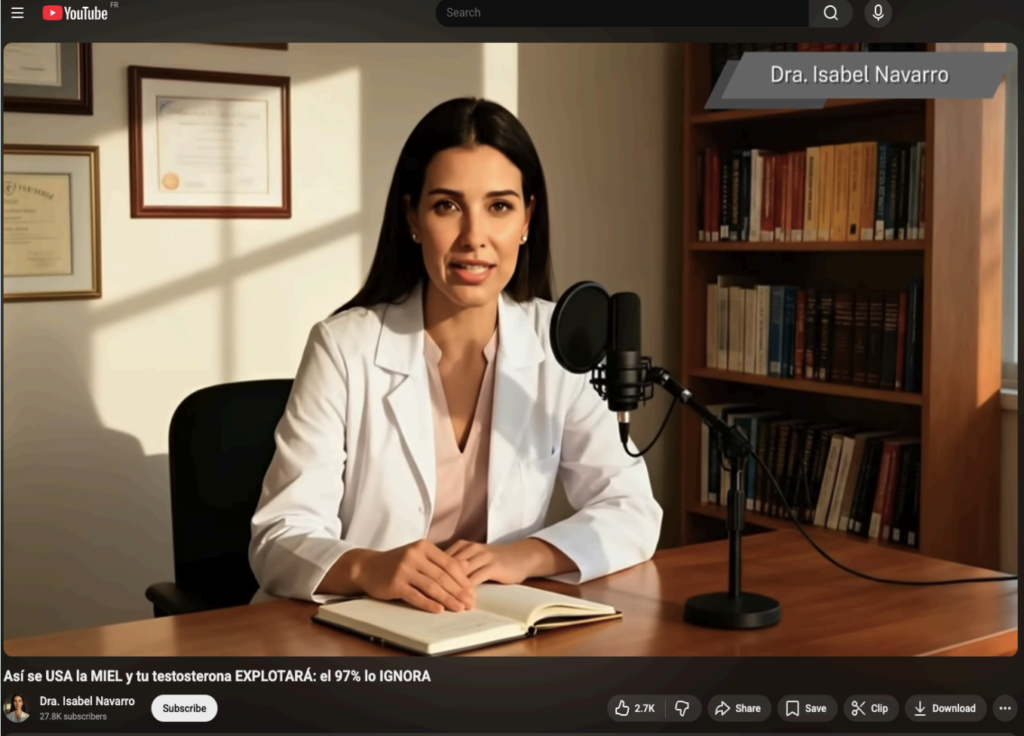

Le rapport cite un exemple emblématique : une chaîne YouTube entièrement consacrée à des vidéos mettant en scène un avatar IA se présentant comme la « Dra. Isabel Navarro », affirmant que le miel augmente le taux de testostérone chez l’homme. La chaîne était monétisée, comptait plus de 27.000 abonnés, et la vidéo avait accumulé plus de 61.000 vues. Aucun label IA n’était visible.

Pour un phénomène qui n’existait pratiquement pas il y a trois ans, la croissance est rapide. Et la réponse des plateformes, très en retard.

LinkedIn : la preuve que la désinformation sur les réseaux sociaux n’est pas une fatalité

Dans ce tableau préoccupant, LinkedIn fait figure d’exception cohérente et répétée. Avec une prévalence de la désinformation autour de 1%, une prime à la désinformation statistiquement non significative, et une proportion de contenus problématiques de seulement 4%, le réseau professionnel se distingue de manière radicale de ses homologues.

Cette singularité tient à plusieurs facteurs structurels : une culture de plateforme orientée vers la crédibilité professionnelle, une modération différente, et des usages qui découragent la viralité émotionnelle au profit de contenus à valeur ajoutée perçue.

Ce contre-exemple est théoriquement précieux : il démontre que la permissivité à la désinformation n’est pas une fatalité technique ou économique. Elle résulte de choix de conception et de politique de modération.

DSA : le règlement européen face aux limites de la transparence des plateformes

Pour rappel, le Digital Services Act européen, entré en vigueur dans sa pleine dimension en juillet 2025, était censé ouvrir une nouvelle ère de responsabilité pour les grandes plateformes. Sur le terrain, le bilan est maigre.

Malgré les demandes formulées par le consortium SIMODS en vertu de l’article 40.12 du DSA, une seule plateforme sur six (LinkedIn) a fourni l’échantillon aléatoire demandé. Les demandes d’accès aux données de monétisation, soumises en janvier 2026, sont restées sans réponse de toutes les plateformes au moment de la publication du rapport.

Sur YouTube et Facebook, où des données partielles ont pu être reconstituées, les résultats sont néanmoins éloquents : 81% des chaînes YouTube peu crédibles remplissant les critères d’éligibilité sont monétisées, contre 90% pour les chaînes de haute crédibilité. Les politiques de démonétisation ne produisent manifestement pas les effets annoncés.

Le rapport formule dès lors une recommandation claire : traiter le non-respect des demandes d’accès aux données des chercheurs comme une priorité d’application du DSA. Sans accès aux données, l’audit indépendant des risques systémiques reste lettre morte.

Ce que les deux vagues SIMODS nous enseignent sur la désinformation en ligne

La valeur du rapport SIMODS ne tient pas seulement à ses chiffres pris isolément. Elle tient à la reproductibilité de ses résultats. Deux collectes indépendantes, séparées de six mois, produisent des conclusions cohérentes : les mêmes plateformes dominent, les mêmes dynamiques s’observent, les mêmes lacunes persistent.

Ce que les deux vagues démontrent ensemble, c’est que la désinformation sur les réseaux sociaux n’est pas un bug. C’est une « feature », au sens où elle résulte de choix de design, de modèles économiques et d’une absence de régulation effective.

La prime à la désinformation ne baisse pas. Elle monte, mêle. Et tant que les algorithmes continueront de récompenser l’émotion au détriment de la vérité, les chiffres de la prochaine vague risquent fort de confirmer la tendance. Jusqu’à…

Xavier Degraux ► Stratège LinkedIn™, Employee Advocacy & Social Selling ► Je transforme Marques, Comex & Dirigeants en Médias (Autorité) ► Thought Leadership Data-Driven & IA ► Ex-Journaliste Éco

FAQ — Questions fréquentes sur la désinformation et les réseaux sociaux

Qu’est-ce que la « prime à la désinformation » sur les réseaux sociaux ?

La prime à la désinformation désigne l’avantage algorithmique dont bénéficient les comptes diffusant des informations fausses ou trompeuses par rapport aux sources crédibles. Elle se mesure en comparant le nombre d’interactions par publication par follower entre ces deux groupes. En 2026, cette prime atteint x11 sur YouTube et x10 sur X/Twitter selon le rapport SIMODS.

Quelle plateforme contient le plus de désinformation en Europe en 2026 ?

Selon le rapport SIMODS 2 publié en mars 2026, TikTok est la plateforme avec la prévalence de désinformation la plus élevée : environ 25% des contenus pondérés par les vues sur des sujets d’intérêt public contiennent des informations fausses ou trompeuses.

Quelle est la part de désinformation générée par intelligence artificielle sur les réseaux sociaux ?

Selon le rapport SIMODS 2, environ 24% de la désinformation identifiée sur TikTok et 19% sur YouTube contient des éléments générés par IA. Seulement 16,5% de ces contenus sont étiquetés comme synthétiques ou générés par IA.

Pourquoi LinkedIn est-il moins touché par la désinformation que les autres réseaux sociaux ?

LinkedIn affiche une prévalence de désinformation d’environ 1%, contre 25% sur TikTok. Cette différence s’explique par la culture professionnelle de la plateforme, ses politiques de modération, et des usages qui privilégient la crédibilité à la viralité émotionnelle. C’est aussi la seule plateforme à avoir pleinement coopéré avec les chercheurs du projet SIMODS.

Qu’est-ce que le projet SIMODS ?

SIMODS (Structural Indicators to Monitor Online Disinformation Scientifically) est un projet européen piloté par Science Feedback, qui mesure de manière indépendante et scientifique la désinformation sur les grandes plateformes numériques en Europe. Son second rapport a été publié le 19 mars 2026, basé sur l’analyse de 3,3 millions de publications.