Le 21 mars 2006, Jack Dorsey lançait une révolution. Vingt ans plus tard, Twitter, devenu X, n’est plus que l’ombre de lui-même. Un réseau « social » qui se caractérise notamment par le démantèlement méthodique de la modération humaine. Au profit du projet idéologique et financier radical d’Elon Musk.

Le 21 mars 2006, un tweet laconique de Jack Dorsey, « just setting up my twttr », lançait une révolution numérique.

Vingt ans plus tard, la plateforme de microblogging rachetée par Elon Musk le 27 octobre 2022 pour 44 milliards USD et rebaptisée X en juillet 2023, revendique 600 millions d’utilisateurs actifs mensuels. Dont 1.691.159 Belges (-8,8% sur un an) et 12.271.889 Français.es (-12,5%) comme je l’ai précisé à l’agence Belga, dont la dépêche a été reprise par une série de médias, dont la RTBF et Moustique.

X bouge encore, certes. Et même avec des niveaux d’activité « historiques »… d’après ce que sa direction indique régulièrement. Mais X n’est plus une place publique neutre. C’est devenu un outil politique biaisé au service de ce que j’appelle la « Musk-économie » (Grok, xAI, Space X…). Un laboratoire à ciel ouvert où la sécurité des utilisateurs a été sacrifiée sur l’autel d’une vision idéologique radicale.

Une vision où la modération humaine des contenus illégaux (pédopornographie, terrorisme, discours de haine…), les risques systémiques (désinformation, cyberharcèlement, revenge porn, deepfakes…) et les pratiques commerciales trompeuses (scams, arnaques, vente de produits illégaux…), est perçue comme un frein idéologique et un coût inutile.

Effondrement de la modération humaine

Je m’en suis encore rendu compte en épluchant méthodiquement les rapports de transparence envoyés par X à la Commission européenne depuis fin 2023, Digital Services Act (DSA) oblige.

J’ai découvert le récit d’un démantèlement méthodique en plongeant dans ces fichiers. Et en les comparant à mes archives.

Entre 2020 et mi-2022, donc avant le rachat par Elon Musk, Twitter, entreprise cotée en Bourse, ne communiquait pas un chiffre global « modérateurs » de manière isolée dans ses rapports financiers. Mais les effectifs totaux de l’entreprise et les estimations des contrats de sous-traitance permettaient de cerner la réalité.

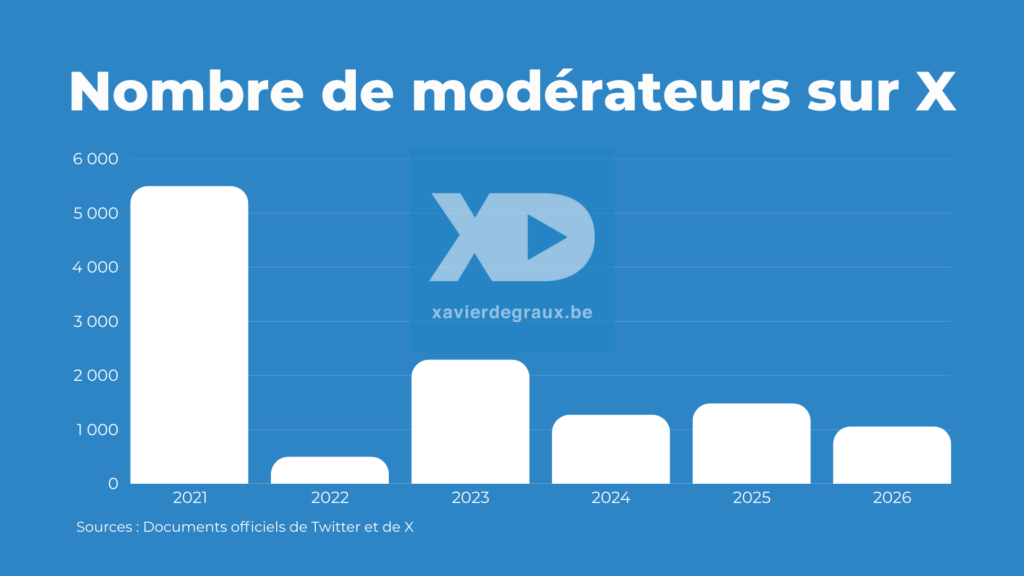

Ainsi, selon plusieurs documents officiels, dont ceux de feu le « Twitter Transparency Center« , de NetChoice et les bilans annuels déposés à la SEC, le gendarme boursier américain, Twitter s’appuyait sur une armée hybride d’environ 5.000 à 6.000 personnes (internes et prestataires externes via Cognizant, Accenture, Majorel et TaskUs) pour surveiller les échanges.

La modération humaine était alors une priorité stratégique pour rassurer les annonceurs face à la désinformation liée au COVID-19 et aux enjeux de l’intégrité électorale. Mais aussi pour répondre à la fois à une croissance annuelle de 30 à 40% des contenus générés par les utilisateurs et aux nouvelles réglementations gouvernementales.

Ensuite, dans la foulée immédiate du rachat, Elon Musk a procédé au licenciement d’environ 80% des salariés de l’entreprise et de plus de 3.000 contractuels externes, en un week-end. L’équipe « Trust & Safety », en charge de la modération du réseau social, a alors été réduite brutalement à moins de 500 têtes.

Ces modérateurs, souvent identifiés par des « badges verts » au siège de San Francisco, étaient pourtant jugés « critiques pour la mission » de la plateforme par les experts du secteur jusque-là…

Leur disparition soudaine ne visait pas seulement une efficacité financière pour rembourser les 13 milliards USD de prêts liés à l’acquisition. Elle reflétait un changement de paradigme vers une modération automatisée et décentralisée.

Les licenciements massifs ont laissé des pans entiers de la plateforme sans surveillance humaine directe, augmentant les craintes d’une recrudescence des abus, de la désinformation et du harcèlement.

Puis les équipes de modération se sont remplumées, aussi discrètement que rapidement…

Ainsi, en octobre 2023, dans sa première déclaration de transparence liée au DSA, X déclarait 2.294 modérateurs mondiaux (à fin juin 2023).

Depuis, la tendance est à nouveau fortement baissière, comme en témoignent mes relevés, toujours dans les documents officiels de X transmis à l’UE dans le cadre du DSA:

- 1.726 modérateurs dans le monde en avril 2024, soit une réduction de 25% des effectifs, qui s’est accompagnée d’une diminution de la couverture linguistique au sein de l’Union européenne, passant de 11 langues couvertes à seulement 7

- 1.275 modérateurs en octobre 2024, dont 88% concentrés sur la seule langue anglaise

- 1.486 modérateurs en avril 2025

- 1.059 modérateurs à fin 2025 pour le monde entier (déclaration de février 2026), contre plus de 6.000, rien que pour l’Europe là, du côté de TikTok, l’autre plateforme particulièrement problématique en termes de modération

X a donc encore supprimé 1.235 postes de modération au cours des 30 derniers mois.

Cela représente une baisse de 54% de sa force de frappe humaine. Autrement dit : la plateforme tourne aujourd’hui avec moins de la moitié des ressources qu’elle jugeait déjà minimales au lancement du DSA.

Evaporation de l’expertise

Peut-être plus grave encore que la baisse quantitative, c’est l’évaporation de l’expertise qui frappe.

- Les « vétérans » de la modération (5 à 7 ans d’expérience) n’étaient plus que 24 fin 2025, contre 127 un an plus tôt

- Plus de 40% des effectifs restants affichent moins de 12 mois d’expérience sur la plateforme

Déserts linguistiques

Au niveau des langues prises en charge, ce n’est guère mieux.

Le rapport de transparence d’avril 2024 chiffrait déjà en creux l’existence de « déserts linguistiques ».

Le rapport rendu public fin février 2026 le confirme : X a instauré des zones de non-droit linguistique au cœur même de l’Europe. Les rapports confirment l’existence de langues pour lesquelles aucun modérateur humain n’est affecté.

Le néerlandais, le danois, le grec, le finnois ne semblent justifier aucun salaire humain, alors que le polonais, le roumain et le hongrois sont suivis, chacun par… un seul modérateur.

Quant au marché francophone, il « survit » avec une dérisoire équipe de 55 modérateurs dont c’est la langue primaire, 55 pour couvrir l’intégralité des contenus mondiaux dans la langue de Molière.

Ces données confirment que la stratégie de X repose sur une concentration des ressources sur quelques langues dominantes, laissant les petits marchés linguistiques dans un vide de surveillance. Une situation jugée dangereuse par les instances européennes, notamment pour la cohésion sociale et la protection des mineurs.

Le mirage du « Tout algorithmique »

Mais rassurons-nous, Pour compenser l’éviscération de ses effectifs, Elon Musk brandit depuis ses débuts dans le game des réseaux sociaux de belles promesses technologiques.

1. Traductions automatiques

Pour justifier ces coupes sombres, X explique tout d’abord dans ses déclarations DSA utiliser des outils de traduction automatique.

Problème : L’IA ne comprend pas les contextes. Elle traite le mot, pas l’intention. Donc si votre entreprise est victime d’un raid ou d’une diffamation utilisant des termes argotiques ou des références culturelles spécifiques, l’IA de X ne verra rien.

2. Intelligence artificielle

Ensuite, X a recours à l’intelligence artificielle pour la détection massive. Un investissement fixe, et non des charges humaines variables.

Selon les déclarations de X auprès de la Commission européenne, l’IA est même le premier filtre de la plateforme.

Au lieu de supprimer les contenus, ce qui demande un arbitrage humain complexe pour éviter les erreurs juridiques, X utilise particulièrement l’IA pour réduire la visibilité des contenus problématiques. C’est de la prévention par la dé-amplification, le fameux « Reach not Speech ».

Mais ce recours massif à l’IA cache lui aussi une réalité peu glorieuse et des failles critiques. L’IA de X, bien que performante pour détecter un mot-clé terroriste ou un pixel de nudité (quoi que), échoue sur trois piliers fondamentaux :

- L’IA ne comprend ni l’ironie, ni le second degré, ni les nuances culturelles. Une insulte amicale entre deux utilisateurs sera traitée de la même façon qu’un harcèlement haineux. À l’inverse, des messages codés de groupuscules extrémistes passent sous les radars car ils n’utilisent pas les mots-clés bannis. Sans comprendre les contextes culturels fins et les langages minoritaires, X expose les communautés vulnérables à des risques accrus.

- L’intelligence artificielle se base sur des modèles d’apprentissage (le « déjà vu »). Demandez à Taylor Swift : face à une nouvelle forme de deepfake ou une rumeur de guerre émergente (comme lors des émeutes de Southport), l’IA est complètement aveugle. Elle a besoin d’humains pour lui apprendre ce qui est dangereux « aujourd’hui ». Sans ces experts, X a et aura toujours un train de retard.

- X utilise sa propre IA, Grok, pour résumer l’actualité. Or, Grok a déjà été pris en flagrant délit de création de fausses informations à partir de tweets parodiques. On se retrouve dans un système récursif où l’IA de modération doit surveiller les erreurs générées par l’IA de la plateforme.

3. Politique de modération

Parallèlement, Musk a orchestré une dérégulation massive, rétablissant plus de 62.000 comptes suspendus tout en supprimant les garde-fous historiques.

Dès fin 2022, X a cessé de sanctionner la désinformation médicale liée au COVID-19, avant d’abroger, en avril 2023, les protections spécifiques contre le harcèlement des personnes transgenres.

Cette doctrine du « Freedom of Speech, not Freedom of Reach » a remplacé la suppression des contenus haineux par une simple limitation de visibilité, souvent invisible et arbitraire.

Ce cadre permissif, complété par le retour des publicités politiques, a créé un environnement qualifié de « toxique » par les observateurs, laissant la plateforme vulnérable aux manipulations à l’approche des scrutins majeurs.

D’ailleurs, cet assouplissement est précisément ce qui a poussé le CCDH (Center for Countering Digital Hate) à affirmer que X est devenu un « lieu sûr pour la haine ».

4. « Community notes »

Enfin, X a fortement accéléré, depuis 2023, le programme de fact-checking « Community Notes ».

Son fonctionnement repose sur un algorithme dit de « bridging » (pontage), qui exige qu’une note soit jugée utile par des contributeurs ayant des perspectives idéologiques historiquement différentes pour être publiée.

Initialement lancé sous le nom de « Birdwatch » en janvier 2021, ce programme présenté comme une alternative décentralisée et transparente à la modération centralisée a été rebaptisé et étendu massivement en 2023 pour devenir l’outil principal de lutte contre la désinformation.

Ainsi, en novembre 2023, le système « Community Notes » comptait environ 133.000 contributeurs bénévoles et leurs notes recevaient des dizaines de millions de vues par jour.

Bien que l’initiative soit séduisante sur papier, elle présente des limites structurelles majeures.

Dans les régions où les contributeurs sont peu nombreux ou partagent les mêmes biais politiques, les notes peuvent rester bloquées indéfiniment, laissant la désinformation prospérer.

Par exemple, sur 1,85 million de notes publiées, seules 0,094% concernaient les langues d’Asie du Sud, malgré l’importance démographique de cette région pour la plateforme.

Dans les faits, les « Community notes » sont avant tout des goulots d’étranglement. Sur les sujets ultra-polarisés (conflits en Ukraine ou au Proche-Orient, climat, élections…), le consensus est par définition impossible.

Résultat : plus de 90% des notes rédigées ne sont jamais publiées car elles n’atteignent pas ce terrain d’entente algorithmique. Et quand elles le sont, c’est bien souvent trop tard…

Le système est lent, réactif, et laisse la désinformation devenir virale pendant des heures avant de daigner, parfois, afficher un correctif. Comme l’ont d’ailleurs largement démontré de nombreuses études, dont celles menées par les chercheurs du MIT Media Lab.

Enquête européenne en cours

Les garants actuels du Digital Services Act (DSA) tentent de s’opposer à ces dérives.

En décembre dernier, Bruxelles a sifflé « la fin de la récréation ». L’amende de 120 millions EUR infligée à X a marqué une rupture historique. Ce montant a sanctionné trois manquements précis constatés lors du premier audit annuel de la plateforme (coches bleues considérées comme pratiques trompeuses, opacité publicitaire et blocage de l’accès aux données pour les chercheurs indépendants).

Concernant la modération, la bataille reste à mener… Une enquête approfondie, ouverte dès le 18 décembre 2023, est en cours. Elle ne porte plus sur la forme, mais sur le fond : la gestion des contenus illégaux et l’efficacité des « Community Notes. Les régulateurs scrutent la réactivité de X lors de crises comme les attentats ou les émeutes. Les conclusions finales sont attendues pour le courant de l’année 2026.

Les risques pour X sont importants, en théorie du moins, puisque le DSA permettrait d’infliger des amendes atteignant 6% du chiffre d’affaires mondial annuel de l’ex-Twitter, en dernier recours.

Par ailleurs, l’entrée en vigueur de la directive européenne sur la transparence salariale en juin 2026 imposera à l’entreprise de plus de 150 employés de publier des rapports détaillés sur ses structures de rémunération. Ce qui pourrait mettre en lumière les conditions de travail des personnels de modération restants.

Et les lois sur la transparence des données d’entraînement pour l’intelligence artificielle (IA Act) exigeront une clarté accrue sur la manière dont les contenus des utilisateurs sont exploités pour les systèmes de modération automatisée.

Bienvenue dans la « Musk-économie »

Pendant que la Commission européenne régule, enquête et marche sur des œufs face à l’administration Trump, Elon Musk, lui, poursuit son chemin vers Mars. Il ne voit plus X comme un réseau social. C’est devenu, pour lui, l’interface de données d’un empire industriel intégré.

La manœuvre est désormais limpide. En février 2026, SpaceX a officiellement absorbé xAI, intégrant de fait X dans son giron. Ce mouvement stratégique transforme le réseau social en un simple centre de données géant destiné à nourrir Grok.

Musk prépare l’introduction en Bourse du siècle pour juin 2026, en espérant lever 50 milliards USD sur les marchés publics pour financer sa conquête spatiale.

Dans ce projet titanesque, la modération est un détail, gênant, mais un détail quand même. En fait, X n’a plus besoin des annonceurs traditionnels pour survivre. Sa valeur réside dans sa capacité à générer de l’influence politique et de la donnée brute pour l’intelligence artificielle.

Pour les marques, rester sur X revient donc à financer indirectement cette ambition politique et spatiale. C’est accepter de naviguer dans un environnement où l’humain a définitivement passé la main à l’algorithme.

Vingt ans après son premier tweet, le constat est sans appel. L’oiseau bleu est mort en 2022. Et son successeur est devenu, entre autres, un risque réputationnel majeur.

Xavier Degraux