En 2026, l’intelligence artificielle générative a franchi un nouveau cap avec un taux d’utilisation mondial de 66%. Mais cette intégration masque une défiance. Entre l’exigence de transparence (86% des consommateurs réclament un étiquetage obligatoire) et la montée des « deepfakes » qui inquiètent 87% des citoyens, les marques font face à un défi historique. En particulier avec les plus jeunes. Analyse.

L’usage de l’IA a franchi un seuil de masse.

- Selon l’IA Index de Stanford, près de 58% des employés utilisent l’IA régulièrement. Et ce chiffre dépasse 80% dans les économies émergentes comme l’Inde ou la Chine.

- D’après une étude de Google, deux tiers des citoyens mondiaux (66%) déclarent avoir utilisé une application d’IA au cours des douze derniers mois, une augmentation de 18% par rapport à 2024.

- Dans le milieu professionnel, selon le dernier Digital Trust Index de Thales, 93% des responsables informatiques déploient des initiatives liées à l’IA générative.

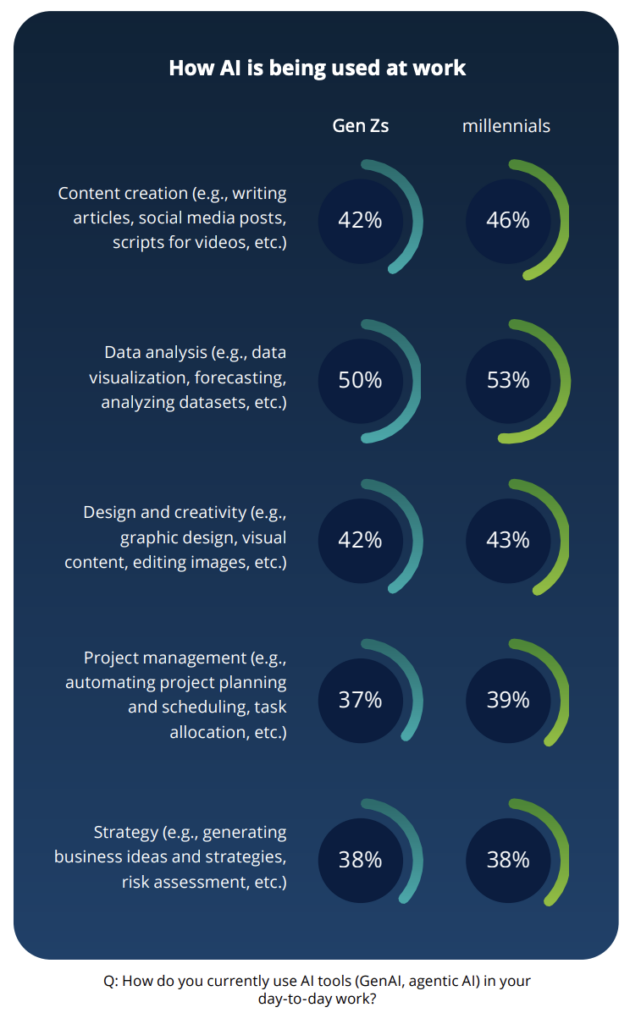

- L’enquête mondiale Deloitte, publiée sous le titre « 2026 Gen Z and Millennial Survey », indique quant à elle que 74% des Gen Z l’utilisent désormais dans leur travail quotidien, contre 57% l’année dernière. Avec une large ventilation d’usages.

L’autre côté de la pièce

Mais ne vous trompez pas de diagnostic. Ces chiffres traduisent une contrainte productiviste… Pas une adhésion volontaire massive.

L’adoption de l’IA générative masque une réalité pleine de doutes, de méfiance, d’anxiété… Que plusieurs études permettent de chiffrer.

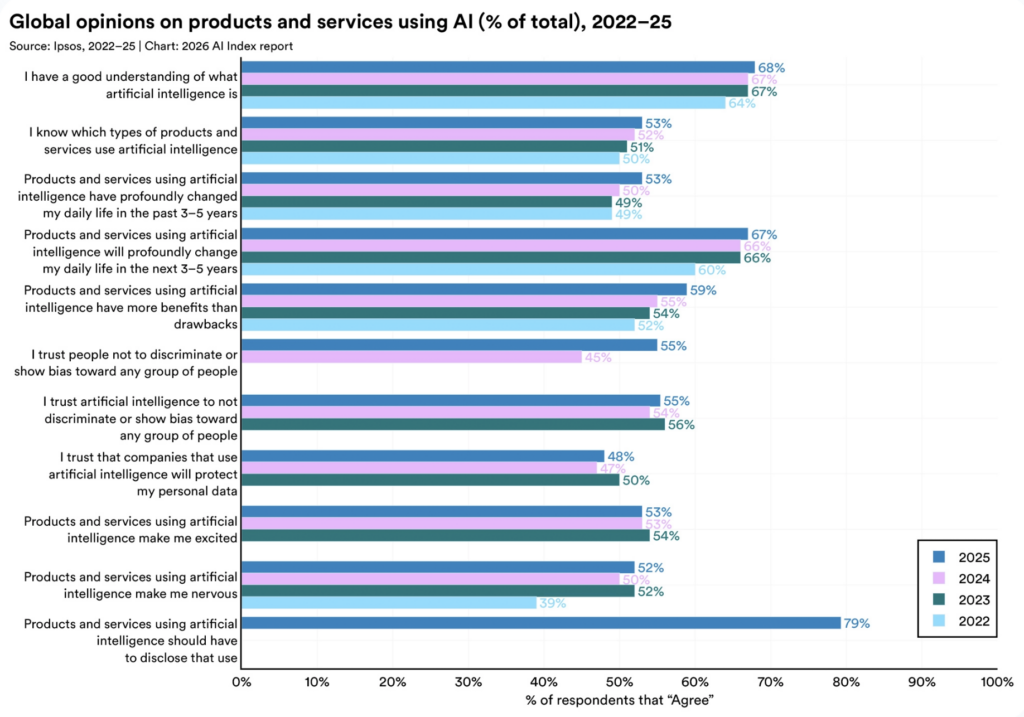

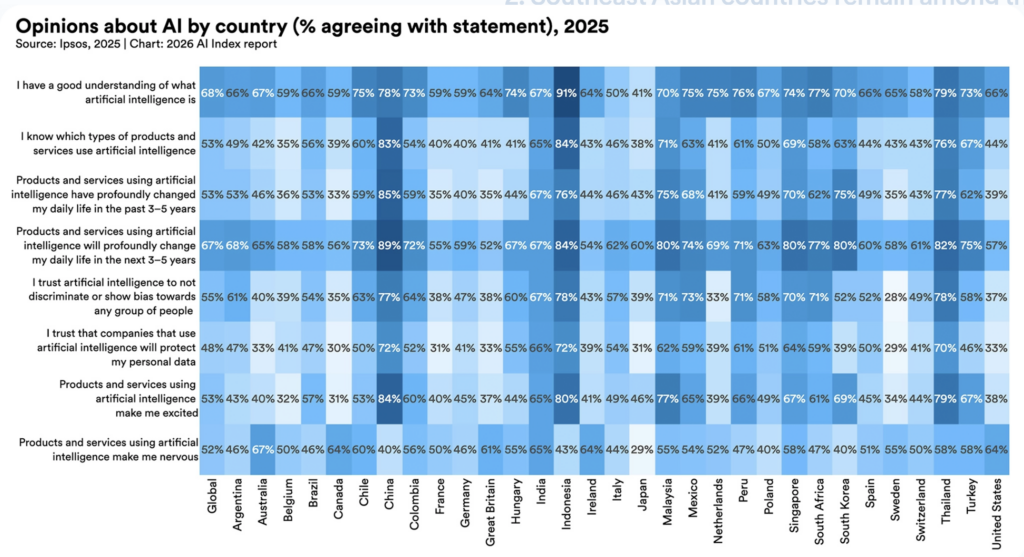

L’AI Index Report de l’Université de Stanford pointe notamment que certes, l’optimisme quant aux bénéfices est passé de 55% à 59% en un an, mais que la nervosité a progresse parallèlement pour atteindre 52% au niveau mondial.

Pire : aux États-Unis, 73% des experts prévoient un impact positif de l’IA sur le travail, contre seulement 23% du côté du grand public.

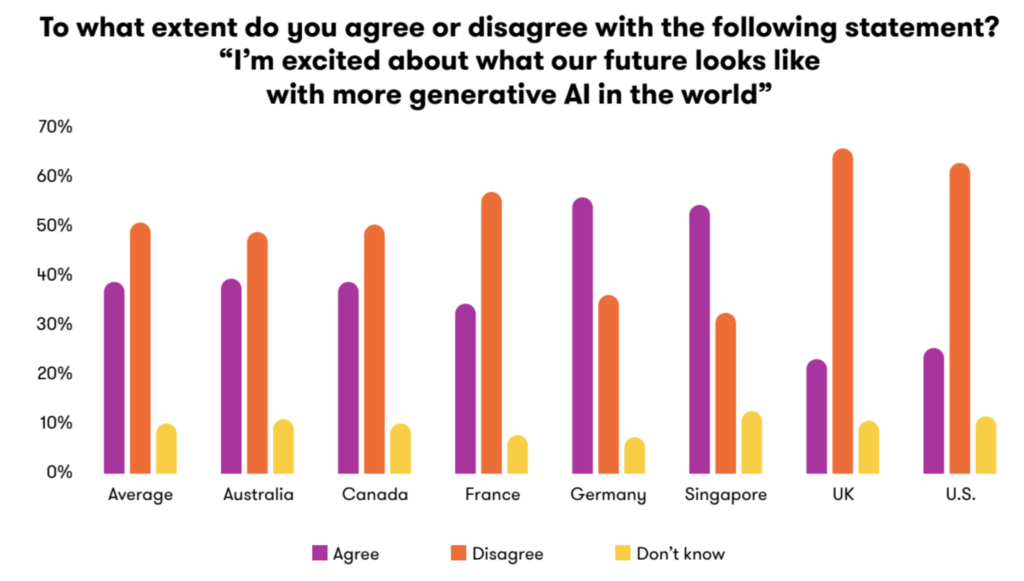

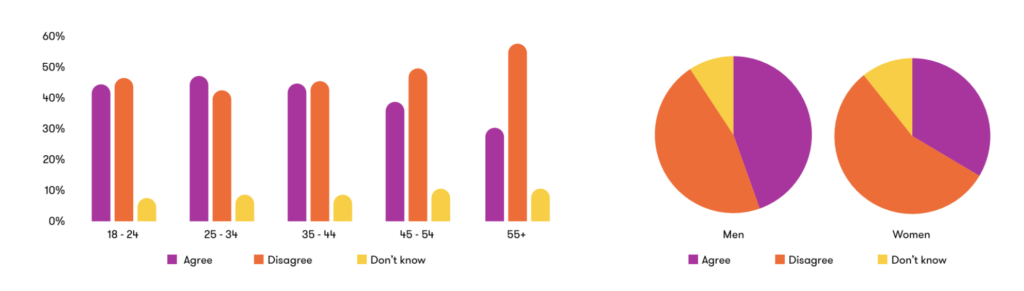

En moyenne, sur les sept marchés étudiés de leur côté par YouGov et Meltwater, la méfiance l’emporte.

La majorité des répondants (51%) exprime sa méfiance face à un futur marqué par l’IA, contre seulement 39% d’opinions favorables (Google était à 50-50 trois mois plus tôt).

Les jeunes adultes de 25 à 34 ans constituent le groupe le plus enthousiaste (48%), suivis de près par les 18-24 ans et les 35-44 ans (45%), alors que ce sentiment tombe à 31% chez les plus de 55 ans.

Une fracture de genre significative est également observée : les hommes sont nettement plus enclins à se dire enthousiastes (45%) que les femmes (34%), ces dernières étant majoritairement réservées (52%) face au développement croissant de l’IA.

Enfin, selon le dernier rapport de l’institut Gallup sur le sujet, l’enthousiasme des jeunes s’est effondré de 14 points en un an. Et l’adoption globale dans leur vie quotidienne stagne à 51% d’utilisateurs hebdomadaires.

Place à l’anxiété (42%) et à la colère (31%).

La quasi-majorité des étudiants se dit même prête à saboter les résultats de ces outils pour freiner leur déploiement en entreprise. Ils commencent même à huer chaque mention de l’IA dans les discours de fin d’année…

Outre la crainte de ne pas/plus trouver d’emplois, la Gen Z a compris le piège du délestage cognitif. Huit jeunes sur dix affirment que déléguer les tâches intellectuelles aux machines va hypothéquer leur capacité d’apprentissage future.

Les jeunes salariés utilisent l’IA parce que le management exige de la vitesse. Pourtant, 48% d’entre eux estiment que les risques de l’IA en entreprise l’emportent largement sur les bénéfices.

La méfiance, posture par défaut

La méfiance envers les entreprises qui déploient l’IA est même plus large. Là aussi, les études le confirment les unes après les autres :

- 23% des consommateurs font confiance aux entreprises pour utiliser l’IA de manière responsable avec leurs données personnelles, d’après l’étude Digital Trust Index de Thales. Et 83% des utilisateurs réclament un étiquetage clair des contenus générés par IA.

- 54% des travailleurs craignent d’être « laissés pour compte », selon Edelman

- Aux USA, en Grande-Bretagne et au Danemark, le ratio de rejet de l’usage croissant de l’IA est de 2:1 (Edelman)

- 70% des salariés suspectent leur CEO de mentir quand il s’agit du futur de l’IA (Edelman encore)

Cette méfiance est alimentée par des craintes concrètes : 64% des Américains pensent que l’IA entraînera une réduction nette du nombre d’emplois au cours des 20 prochaines années (Stanford).

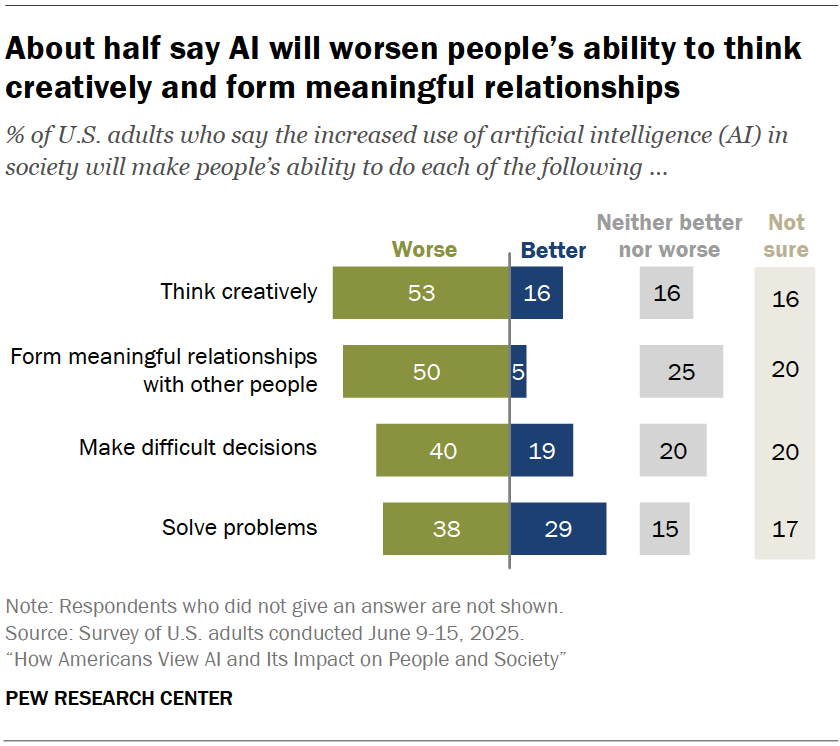

De plus, 53% craignent une érosion de la créativité humaine et 50% redoutent un affaiblissement des relations humaines (Pew Research).

L’impératif de transparence et le recul des marques

Pour le public, la transparence est une exigence de survie pour les marques.

Environ 86% des consommateurs sondés par YouGov et Meltwater exigent que tout contenu généré par IA soit explicitement étiqueté.

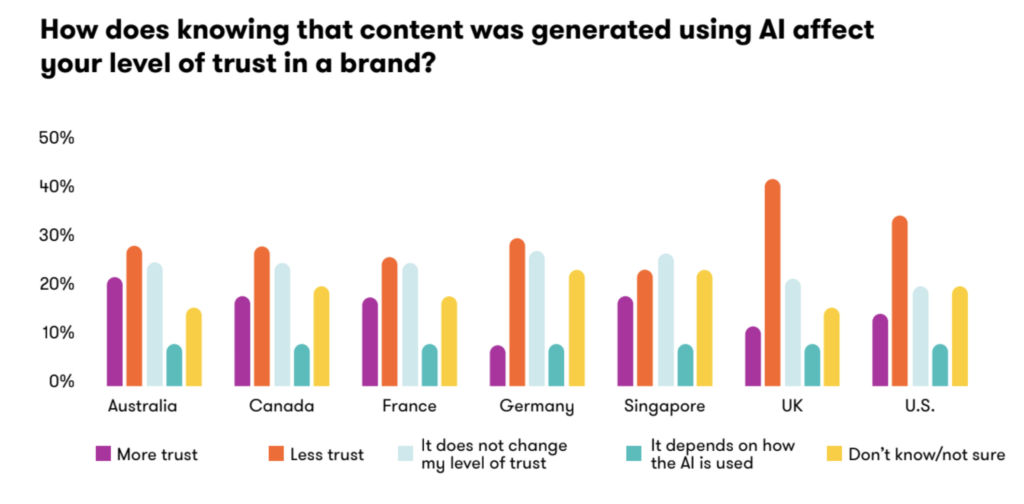

- Peur de l’ « AI slop » : 32% des sondés affirment qu’apprendre qu’une marque utilise l’IA réduirait leur confiance envers elle

- Aversion pour l’IA dans la communication : 50% des consommateurs préfèrent traiter avec des marques qui n’utilisent pas l’IA dans leurs messages publicitaires, affirme de son côté Gartner

- Problème du « jardin fermé » : 51% des utilisateurs d’outils de recherche par IA ont l’impression d’être enfermés dans un système limitant la vérification (étude Yelp/morning Consult)

Crise de la vérité

L’IA générative a instauré une « crise du savoir », comme la nomme l’Unesco.

En 2026, les deepfakes sont devenus routiniers et techniquement indétectables pour le public (UC Berkeley).

- Érosion de la preuve : L’existence des deepfakes permet désormais de nier des preuves réelles en les qualifiant de fabrications (le « dividende du menteur »)

- Risques de fraude : Les pertes liées à la fraude par IA aux États-Unis pourraient atteindre 40 milliards de dollars d’ici 2027 (Unesco)

- Scepticisme Informationnel : 68% des consommateurs se demandent fréquemment si le contenu qu’ils voient en ligne est réel (Gartner)

Et la situation risque encore de se corser avec les annonces du dernier Google I/O. Le moteur de recherche historique s’efface au profit d’un écosystème fermé où Gemini et des agents IA trient, résument et décident à notre place. Nous passons du dialogue avec la machine au monologue entre machines, entre agents IA.

Autrement dit : l’information devient virtuellement invérifiable à la source. Ce qui pousse certains internautes, les plus jeunes singulièrement, à s’orienter vers une recherche collective de la vérité, pour valider l’information horizontalement, à travers les espaces de discussion et les sections commentaires sur les réseaux sociaux, en s’appuyant uniquement sur l’avis de leurs pairs.

Une question de géographie

Mais ne généralisons pas. Selon l’étude de Stanford, le niveau de confiance dans l’IA varie radicalement selon les régions :

- L’optimisme de l’Asie du Sud-Est : En Malaisie, Thaïlande et Indonésie, plus de 80% des citoyens pensent que l’IA améliorera leur vie

- Le scepticisme occidental : Les États-Unis affichent le taux de confiance le plus bas envers leur gouvernement pour réguler l’IA (31%), contre 81% à Singapour

- Le modèle européen : L’Union européenne est l’entité la plus respectée pour réguler l’IA (53%)

Pas étonnant dès lors que, dans certains pays, la contestation sorte définitivement des écrans. Qu’elle devienne politique, environnementale et locale.

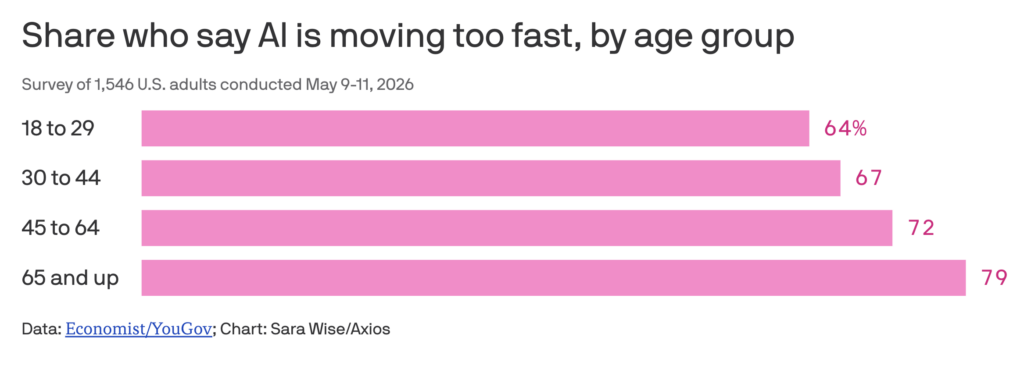

Aux USA en particulier, la majorité des adultes trouve que « l’IA va trop vite », selon YouGov.

Et les tensions extrêmes autour de la construction des data centers, de New Jersey à Indianapolis, montrent que la Gen Z refuse de voir ses quartiers redessinés et ses ressources énergétiques siphonnées pour alimenter des fermes de serveurs.

Vers une confiance « souveraine » et « humaine » ?

Pour restaurer la confiance, les organisations privilégient deux axes :

- L’IA souveraine : 83% des entreprises considèrent l’IA souveraine comme une priorité stratégique pour garantir leur indépendance, d’après Deloitte

- Le retour à l’humain : Selon CapGemini, la demande pour un support client humain explose, 74% des consommateurs valorisant l’assistance en personne pour les actes complexes

La confiance ne se gagne plus par la performance technique. Mais par la preuve de l’authenticité et le maintien de l’implication humaine…

Les chiffres de l’institut Gallup sont sans appel : moins de 20% des jeunes feraient confiance à une IA pour du conseil financier, du service client ou du tutorat.

Plus radical encore : 69% des jeunes travailleurs accordent leur confiance à un travail produit exclusivement sans IA, contre seulement 3% pour un résultat 100% automatisé.

Opportunité, y compris sur LinkedIn

Sur LinkedIn, l’un de mes terrains de jeu favoris, le coût d’opportunité pour les entreprises est immédiat.

Continuer à inonder LinkedIn de posts génériques rédigés par des robots est un suicide réputationnel (même LinkedIn lutte contre l’ « IA slop »). Pour percer l’opacité des nouveaux moteurs de recherche, la solution n’est pas logicielle. Elle viendra de vos leaders et de vos collaborateurs.

Vos experts, vos managers et vos dirigeants doivent reprendre la parole en leur nom propre.

L’Employee Advocacy et le Thought Leadership ne sont plus des options marketing. Ce sont les seuls remparts viables contre l’invisibilisation algorithmique.

Vos équipes doivent incarner votre marque pour recréer ce pont de confiance détruit par les machines.

Et si vous avez besoin d’aide pour transformer vos marques, CEO, Comex & ambassadeurs en médias d’autorité, vous savez vers qui vous tourner…

Xavier Degraux ► Stratège Communication Corporate ► Expert LinkedIn™, Employee Advocacy, Thought Leadership & Social Selling ► Je transforme Marques, ComEx & Dirigeants en Médias (Autorité) ► Data-Driven & IA ► Ex-Journaliste Éco