Après avoir regardé de près les données, les usages réels des jeunes et les limites techniques du modèle australien, je suis convaincu d’une chose : interdire les réseaux sociaux jusqu’à 15 ou 16 ans rassurerait certains adultes/politiques… mais n’éduquerait pas les jeunes et ne transformerait pas les plateformes.

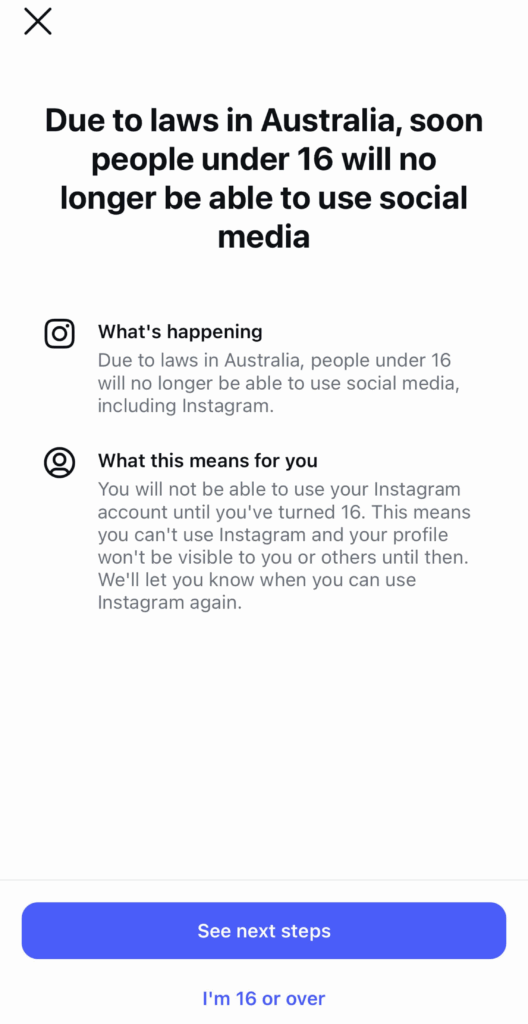

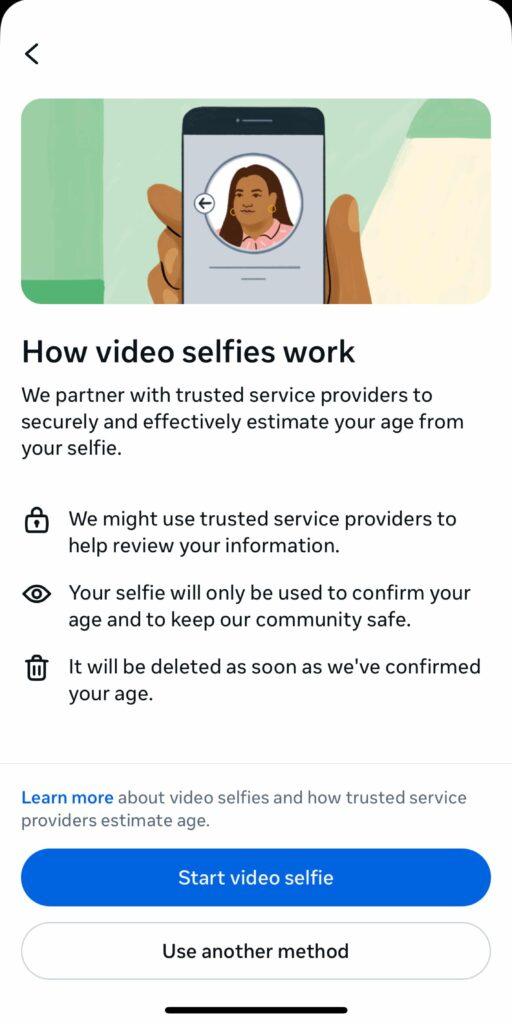

L’Australie a choisi d’avancer la première (parmi les pays occidentaux), en imposant dès le 10 décembre 2025 un bannissement strict de Facebook, Instagram, TikTok, Snapchat, X, YouTube, Reddit, Twitch et Kick pour tous les mineurs de moins de 16 ans. La mesure touche environ 2 millions de mineur.e.s.

La Nouvelle-Zélande veut suivre. Le Danemark aussi. Le Brésil, l’Indonésie, la Malaisie et Singapour ont exprimé leur volonté de durcir fortement les limites d’âge et les contrôles autour des réseaux sociaux pour les mineurs.

Et en Europe, on essaie de s’entendre… Alors que plusieurs pays européens, dont la France, l’Espagne et la Belgique, souhaitent une interdiction pure et simple des réseaux sociaux en-dessous de 15 ans, le Parlement européen propose désormais une majorité numérique harmonisée à 16 ans… avec consentement parental entre 13 et 16 ans.

Le laboratoire australien : un tournant radical, instructif… et déjà contourné

Tous les regards sont donc tournés vers l’Australie et vers son Online Safety Amendment Act (Social Media Minimum Age) de 2024, entièrement orientée vers l’interdiction, qui impose aux plateformes de purger leurs comptes et de bloquer tout accès aux mineurs.

Je veux être clair. Ce choix radical repose sur une inquiétude réelle : explosion du cyberharcèlement, dégradation de la santé mentale, exposition à la haine et aux contenus toxiques. Je ne minimise pas ces risques – je les constate aussi au quotidien.

Mais les premiers signaux montrent déjà les limites d’un bannissement pur :

- Migration des adolescents vers des plateformes “exemptées” ou moins régulées, dont Lemon8 (Bytedance) et Yope

- Explosion de l’usage des VPN

- Déguisements pour tromper les IA

- Photos de profil générés par IA

- Faux documents d’identité ou documents empruntés à un.a ami.e plus âgé.e

- Grimaces « vieillissantes »

- Recours en justice par des associations et, bien sûr, par des plateformes, comme Reddit

- …

En réalité, ce que les Australiens découvrent aujourd’hui, nous le savons depuis des années :

- Interdire une pratique sans transformer l’environnement numérique ne fait que la déplacer ailleurs, souvent dans des espaces encore moins sécurisés.

- Quand un ado a le sentiment qu’on lui retire une liberté, il est souvent tenté de la reconquérir (effet de « réactance »). Plus on répète “tu n’as pas le droit d’être sur TikTok”, plus on risque de transformer ce réseau en « fruit défendu ».

Ce que disent vraiment les données sur la santé mentale : des risques sérieux, mais aucune preuve qu’une interdiction totale soit la solution

Les grandes enquêtes internationales – y compris celles de l’OMS (dont celle de référence signée HBSC) – montrent une hausse préoccupante de l’usage problématique des réseaux, corrélée à l’anxiété, aux troubles dépressifs et aux difficultés de sommeil.

Mais les études sérieuses disent aussi autre chose : il n’existe pas, à ce jour, de lien de causalité direct prouvé entre réseaux sociaux et dépression des adolescents.

Le Conseil supérieur de l’Éducation aux médias en Belgique (CSEM) le rappelle très clairement : les réseaux ne sont pas la cause en soi, mais plutôt des amplificateurs de fragilités préexistantes.

Là où la science est beaucoup plus nette, c’est sur un point précis : réduire l’usage le soir améliore le sommeil et les performances scolaires.

Autrement dit, les solutions ciblées fonctionnent mieux que les interdictions générales.

Le vrai chantier n’est pas l’âge, mais les algorithmes

Contrairement à l’Australie, l’Union européenne mise moins sur une interdiction frontale que sur la transformation du modèle technique et économique des plateformes, sur ce qui cause vraiment les dommages :

- dark patterns

- scroll infini

- autoplay

- recommandation algorithmique basée uniquement sur l’engagement

- contenus viraux toxiques

- modalités addictives

- absence de filtres adaptés aux mineurs

Le Digital Services Act (DSA) donne déjà à la Commission des leviers puissants pour obliger Snapchat, YouTube, TikTok et consorts à revoir leurs pratiques.

Un approfondissement technico-juridique est sans doute nécessaire. Mais le chantier européen est clair : sécuriser l’environnement numérique avant de décider qui peut y entrer.

C’est plus lent, plus complexe… mais aussi plus durable et plus protecteur.

La Belgique : entre zigzag politique…

On verra si la voie européenne, « minimaliste », conviendra aux 27. Ou si certains Etats iront plus vite, plus loin, plus fort…

En Belgique, où la règle de base reste celle du RGPD (pas en-dessous de 13 ans, sauf avec consentement parental), le discours politique reste très divisé… alors même que les experts, eux, sont presque tous d’accord.

La tentation d’interdire strictement jusqu’à 15 ans existe toujours chez certains politiques, en particulier Vanessa Matz (Les engagés), en charge du numérique au gouvernement fédéral, et Jacqueline Galant (MR), Ministre des médias en Fédération Wallonie Bruxelles, où l’usage récréatif du smartphone est interdit dans toutes les écoles depuis la rentrée 2025, de la maternelle au secondaire.

L’été dernier, toutes deux ont évoqué la nécessité d’un cadre européen commun. Mais quelques semaines plus tard, lorsque 25 États de l’UE ont signé la Déclaration de Jutland pour renforcer la protection des mineurs en ligne (âge minimum, vérification d’âge, lutte contre les designs addictifs…), la Belgique, elle, s’est abstenue.

On craindrait, du seul côté flamand, où plus de 500 médecins ont signé une lettre ouverte alertant sur les effets du “trop d’écrans / réseaux sociaux” (sommeil, anxiété, concentration, etc.), des systèmes de vérification d’âge trop intrusifs…

…Et consensus d’experts

Qu’en dit le Conseil supérieur de la santé (CSS) ? Dans l’avis qu’il vient tout juste de rendre au Ministre fédéral de la Santé, il plaide pour une approche progressive et réaliste.

Avant 13 ans, pas de comptes sur les réseaux sociaux sans consentement parental.

Mais le passage clé concerne surtout les 13–16 ans : selon le CSS, c’est une période où l’on doit avant tout accompagner les usages plutôt que les réprimer. Concrètement, cela signifie encourager la discussion en famille, renforcer l’éducation aux médias à l’école, aider les adolescents à comprendre ce qui se joue derrière les notifications, les algorithmes et la comparaison sociale, et les guider vers des usages plus actifs que passifs.

Le CSS insiste aussi sur des leviers structurels souvent absents du débat politique : exiger plus de transparence sur les algorithmes, appliquer de véritables principes de sécurité dès la conception pour les mineurs, et créer un centre d’audit indépendant chargé de surveiller les pratiques des plateformes en temps réel.

À ma connaissance, tous les autres experts belges vont dans le même sens jusqu’ici : interdire ne règlera rien.

Tous défendent la même position : une interdiction crée un faux sentiment de sécurité, renforce la clandestinité, détériore le dialogue éducatif… et laisse intact le problème central : les plateformes elles-mêmes.

Child Focus le dit très bien : interdire, c’est punir les victimes plutôt que s’attaquer aux causes structurelles.

Mediawijs est encore plus direct. Interdire ? Ni réaliste, ni efficace, ni juste.

Je partage complètement leurs points de vue.

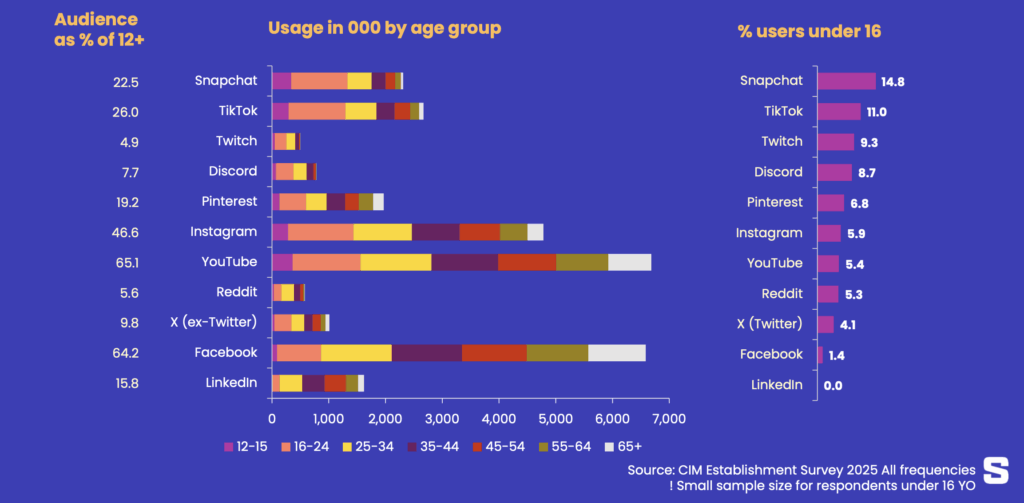

D’autant que les usages réels des jeunes belges confirment que nous sommes très loin d’une déconnexion volontaire ou massive : TikTok, Instagram et Snapchat dominent largement les pratiques. Et surtout, la majorité des jeunes s’informent désormais via les réseaux sociaux, avant les médias traditionnels.

Les exclure d’office, c’est les couper d’un pan entier de la vie publique. C’est aussi faire fi des bénéfices des réseaux sociaux à un âge clé.

Parce qu’on réduit souvent les réseaux sociaux à leurs risques, mais les données montrent une image plus nuancée. La plupart des ados disent qu’ils y trouvent d’abord du lien social, du soutien, un espace pour s’exprimer et créer.

Loin d’être uniquement un facteur aggravant, les réseaux sociaux constituent paradoxalement la première « salle d’attente » pour les jeunes en souffrance psychique.

Les études récentes, telles que le rapport Hopelab 2024 ou les travaux de la commission française sur les écrans, révèlent que les adolescents présentant des symptômes dépressifs surinvestissent ces plateformes pour combler les carences de leur prise en charge : ils y cherchent l’anonymat, une accessibilité immédiate et surtout une validation par les pairs (pair-aidance) que leur entourage adulte peine souvent à offrir.

Pour cette jeunesse vulnérable, l’algorithme devient un outil pour trouver des « semblables » et briser l’isolement, transformant ainsi des espaces comme TikTok ou Instagram en refuges d’entraide communautaire, et ce malgré les risques réels de désinformation et d’auto-diagnostic erroné inhérents à ces pratiques.

Et pour les jeunes les plus isolés (LGBTQ+, minorités, ados en souffrance…), les réseaux peuvent même être un filet de sécurité et un lieu d’affirmation identitaire.

Le vrai problème n’est pas l’accès des jeunes

Snapchat, TikTok, Twitch, Discord… ne sont pas des plateformes dangereuses parce que les jeunes de moins de 16 ans en sont de grands utilisateurs (comme l’a démontré Space, e Belgique, sur base d’une enquête du CIM).

Non, elles sont dangereuses parce qu’elles sont conçues pour maximiser le temps de cerveau disponible, souvent au détriment de la santé mentale.

TikTok, par exemple, est aujourd’hui l’illustration parfaite d’un algorithme capable d’enfermer les adolescents dans des spirales anxiogènes ou autodestructrices, comme l’a démontré Amnesty International.

Je l’ai expliqué récemment à un journaliste qui me demandait de réagir à cette étude : nous avons en Europe la version la plus « débilisante » de TikTok, loin du modèle chinois Douyin, qui impose des limites de temps, des contenus éducatifs et une modération stricte.

Le cœur du problème n’est donc pas l’âge d’accès. Le cœur du problème, ce sont les algorithmes de recommandation et les architectures addictives, ainsi que les bien trop faibles moyens budgétaires alloués à l’éducation aux médias sociaux.

Si on n’interdit pas, qu’est-ce qu’on fait alors ?

L’avis tout juste publié du Conseil supérieur de la santé le confirme : aucune mesure isolée ne suffira. Interdire rassure, mais ne protège pas vraiment. Si on veut agir utilement et durablement, quatre leviers sont bien plus efficaces qu’une prohibition totale :

- Limiter les fonctionnalités les plus addictives pour les mineurs

Par défaut, réduire drastiquement les mécanismes qui capturent l’attention : temps de visionnage maximal, autoplay coupé, fin du scroll infini pour les comptes mineurs. - Imposer des algorithmes “sûrs par défaut”

Les plateformes doivent cesser de pousser du contenu uniquement optimisé pour l’engagement. Pour les moins de 16 ans, les recommandations doivent être transparentes, adaptées et orientées vers le bien-être. - Renforcer massivement l’éducation aux médias dans les écoles

Avec Child Focus, Mediawijs, Betternet et les acteurs de terrain, on donne aux jeunes les compétences pour comprendre les plateformes, déjouer les pièges de la comparaison sociale et adopter des usages responsables. - Accompagner les parents plutôt que les culpabiliser

Proposer des repères concrets : comment parler des réseaux, comment fixer des règles réalistes à la maison, comment organiser des routines sans écrans avant le coucher et pendant les repas.

À cela s’ajoute désormais une recommandation forte du CSS : créer un centre d’audit indépendant chargé de surveiller en temps réel les pratiques des plateformes et l’impact des technologies émergentes. Autrement dit, s’attaquer enfin au cœur du problème : la façon dont les environnements numériques sont conçus.

Le débat ne devrait donc pas se résumer à un âge d’interdiction symbolique. Protéger les jeunes, c’est construire un écosystème numérique plus sain, plus transparent et plus éducatif, pas leur fermer la porte d’un monde qui fait déjà partie du leur.

Xavier Degraux ► Stratège LinkedIn™, Employee Advocacy & Social Selling ► Je transforme Marques, Comex & Dirigeants en Médias (Autorité) ► Thought Leadership Data-Driven & IA ► Ex-Journaliste Éco