En 2025, la confiance se délite encore un peu plus sur les réseaux sociaux, qui restent pourtant populaires. Les contenus synthétiques se banalisent, les labels restent inégaux, la conversation migre vers le privé. Pour rester crédibles, plateformes et marques doivent prouver l’origine des contenus, corriger vite et expliquer leurs méthodes.

La méfiance à l’égard des réseaux sociaux continue à croître. Et elle porte sur presque tous les aspects des plateformes : la fiabilité des contenus, l’intégrité des publicités, la manipulation idéologique des algorithmes, l’impact sur la santé mentale, le coût environnemental, le modèle économique…

Sur le volet éditorial, deux mouvements semblent se rejoindre : la désinformation structurée et l’irruption des contenus synthétiques, générés ou transformés par IA.

Les réseaux sociaux, sources de (dés)information

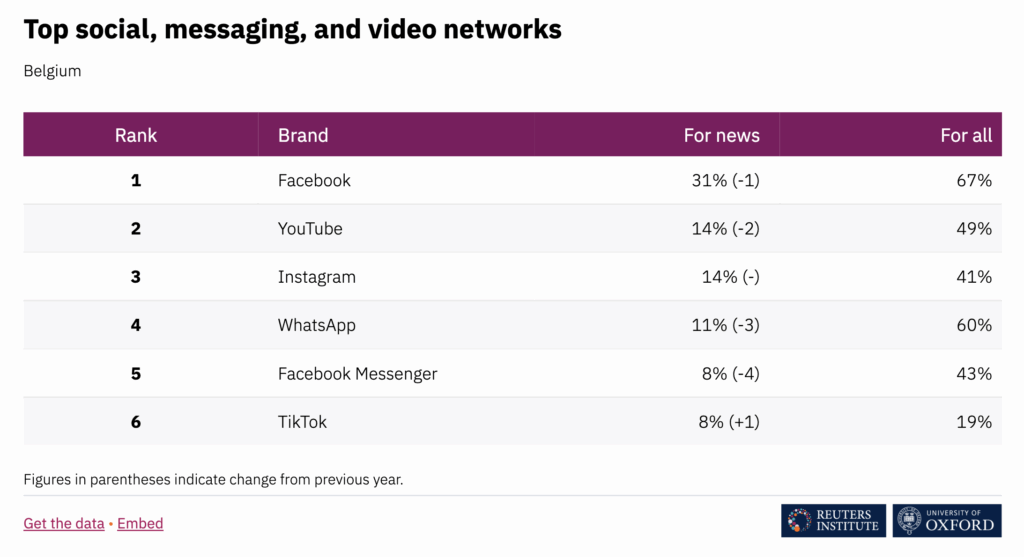

Côté (dés)info, le dernier rapport du Reuters Institute for the study of journalism pointe une nouvelle montée des plateformes sociales comme portes d’entrées vers l’actualité, au détriment des sites et applications des médias d’information (dont la production est parfois influencée également par les algos). En particulier aux Etats-Unis, et en particulier Instagram, TikTok, YouTube et WhatsApp.

En Belgique, il y a un léger tassement de l’usage des réseaux sociaux pour s’informer (à part sur TikTok).

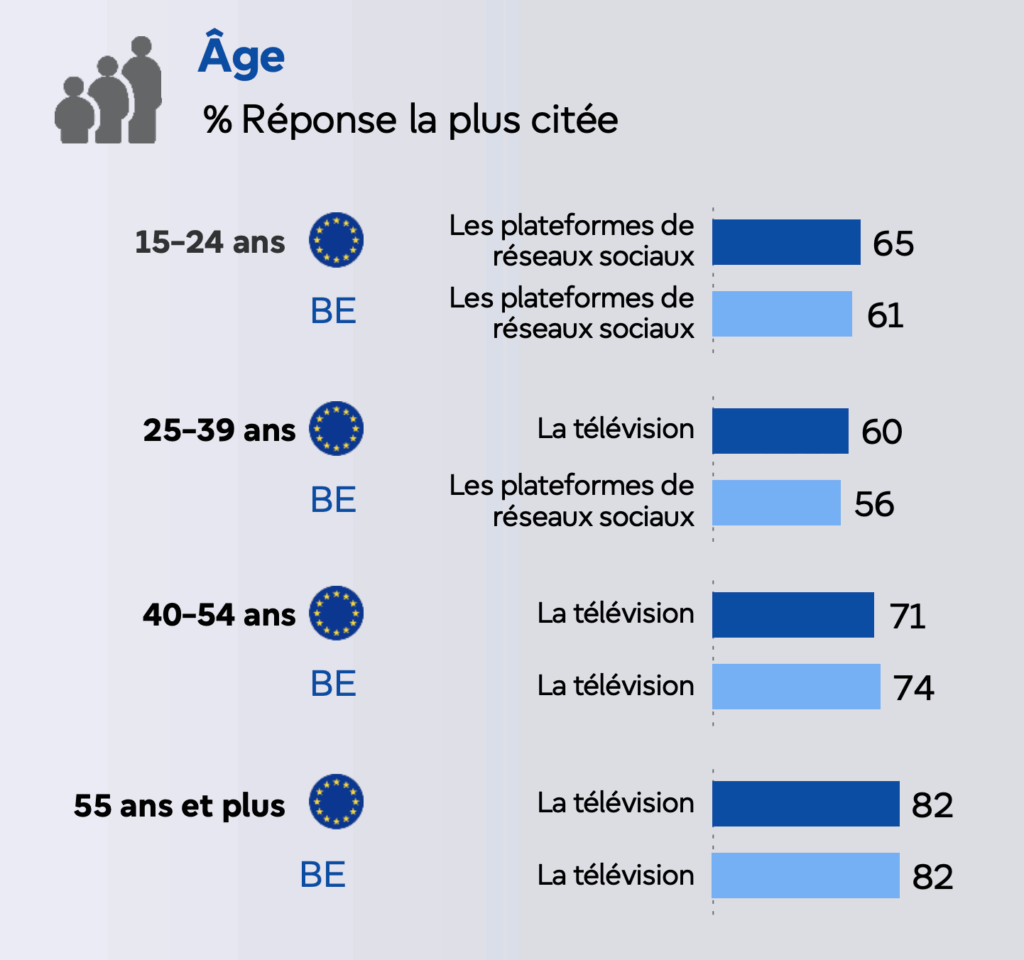

Mais le mouvement est en cours… À bien y regarder, les plus jeunes ont en effet déjà basculé.

D’après l’édition 2025 du Flash Eurobaromètre, 65% des Belges de 15 à 24 ans déclarent s’informer sur les réseaux sociaux, contre 61% via la télévision. En 2023 : 66% citaient la TV, 59% les réseaux. En deux ans, la hiérarchie s’est donc renversée, même en Belgique, marquant le passage symbolique du journal télévisé au fil TikTok.

Défiance accrue

Pourtant, paradoxalement, cet usage des réseaux sociaux comme sources d’information se combine avec une défiance accrue.

En Belgique toujours, une étude montre que 38% des jeunes Flamands doutent de la fiabilité des informations sur les réseaux sociaux, en particulier sur TikTok, et peinent à distinguer le vrai du faux.

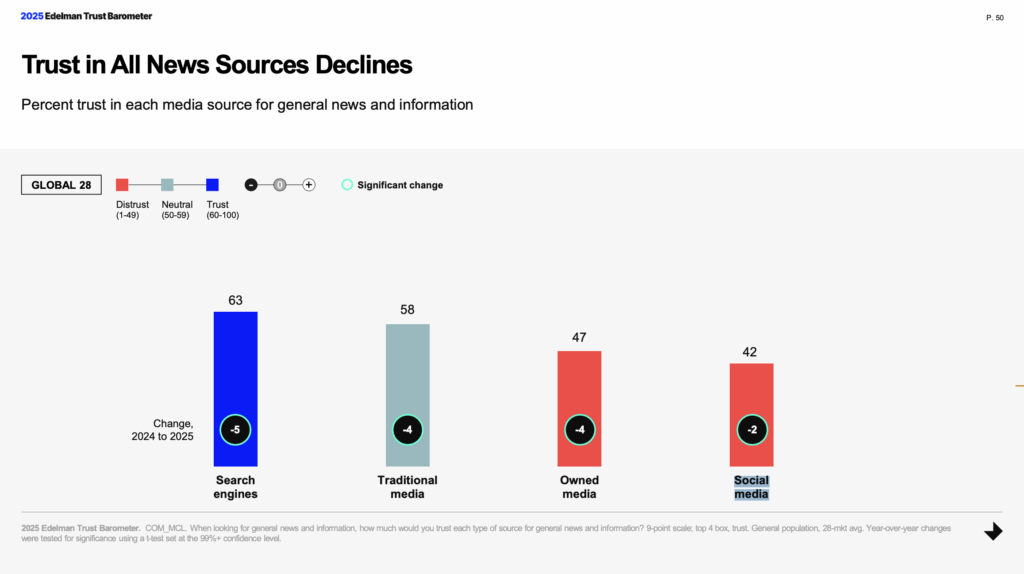

D’après le dernier Baromètre d’Edelman, qui souligne le caractère planétaire et global (toutes institutions confondues) de la crise actuelle de confiance, les réseaux sociaux sont toujours les pires sources d’infos, avec 42% d’indice de confiance, soit deux points de moins qu’il y a un an.

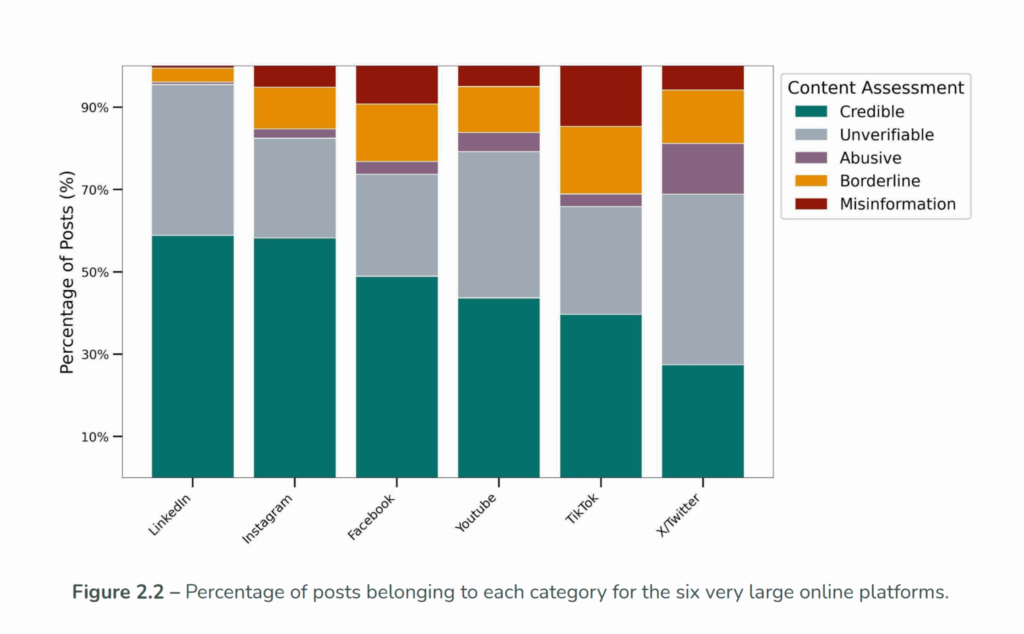

Les résultats du SIMODS Report 2025 (Social Media and Disinformation Study), première étude européenne systématique de la désinformation sur les grandes plateformes, sont plus précis :

- TikTok est la plateforme la plus exposée à la désinformation, avec 20,2% de contenus relevant du faux avéré

- Ce taux monte à 34% en incluant les contenus « borderline » ou abusifs

- Facebook suit avec 13,4%, X (ex-Twitter) avec 10,6%, YouTube et Instagram autour de 8%, LinkedIn fermant la marche à 2,3%

En France, dans les associations et fondations, plus de 60% des utilisateurs de réseaux sociaux manifestent une défiance croissante envers les plateformes, en raison des algorithmes jugés opaques, de la prolifération des contenus polarisants, du manque de modération perçue, de la difficulté d’introduire des recours…

Au Royaume-Uni, l’autorité de régulation Ofcom relève que 4 adultes sur 10 disent avoir vu des infox ou des deepfakes au cours des quatre dernières semaines.

Au Canada, la confiance envers les réseaux sociaux s’effondre aussi et la méfiance face aux contenus générés par l’IA (Marie Dollé convoque Baudrillard pour parler de simulacre et d’ « infra-réel ») est très forte : 74% des utilisateurs sont préoccupés par les “hypertrucages” et la mésinformation.

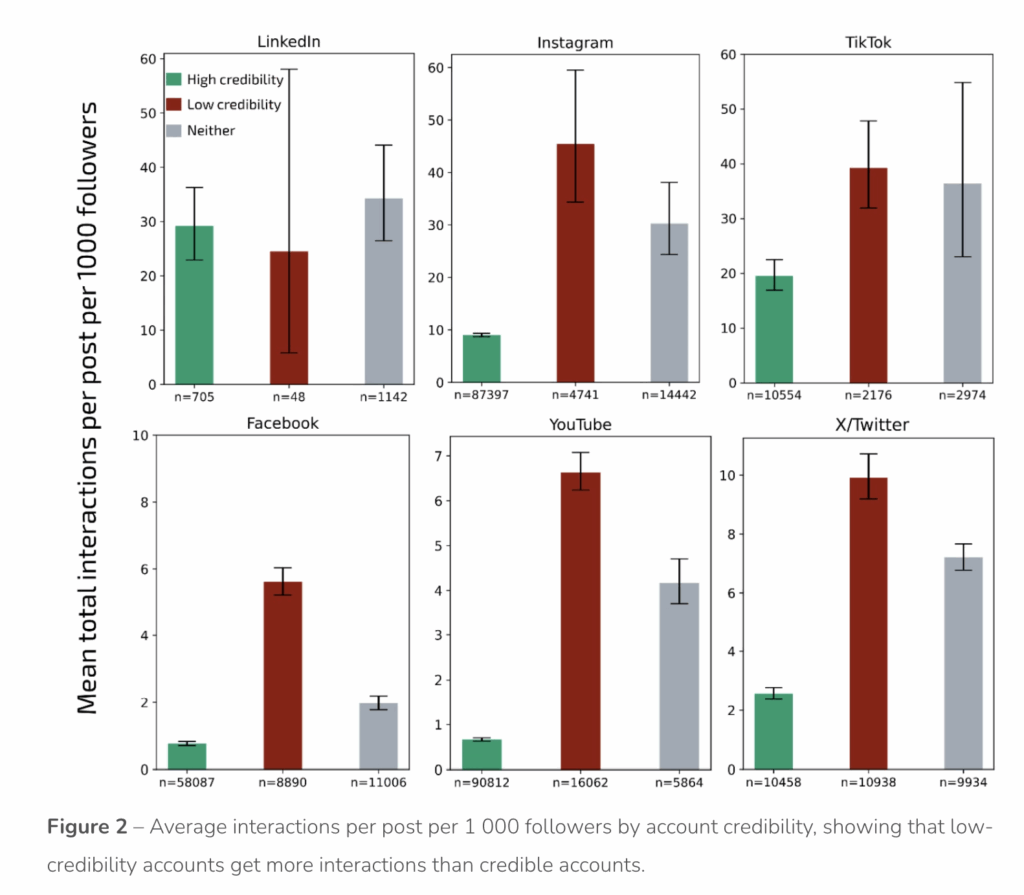

Autre constat majeur : sur toutes les plateformes, sauf LinkedIn, les contenus de faible crédibilité génèrent davantage d’interactions que les sources fiables. Jusqu’à huit fois plus sur YouTube, sept fois sur Facebook, cinq fois sur X et Instagram, deux fois sur TikTok.

Cette « prime au faux » ne tient pas à une intention idéologique explicite des plateformes, mais à la logique de leurs algorithmes : maximiser l’engagement, donc favoriser les contenus qui suscitent le plus de réactions émotionnelles, souvent les plus outranciers, polarisants ou trompeurs.

Contenus et IA : la banalisation du doute

La montée de l’IA générative accentue encore la méfiance. Au point que l’on ne croit plus spontanément ce que l’on voit, mais on ne sait pas non plus quoi croire.

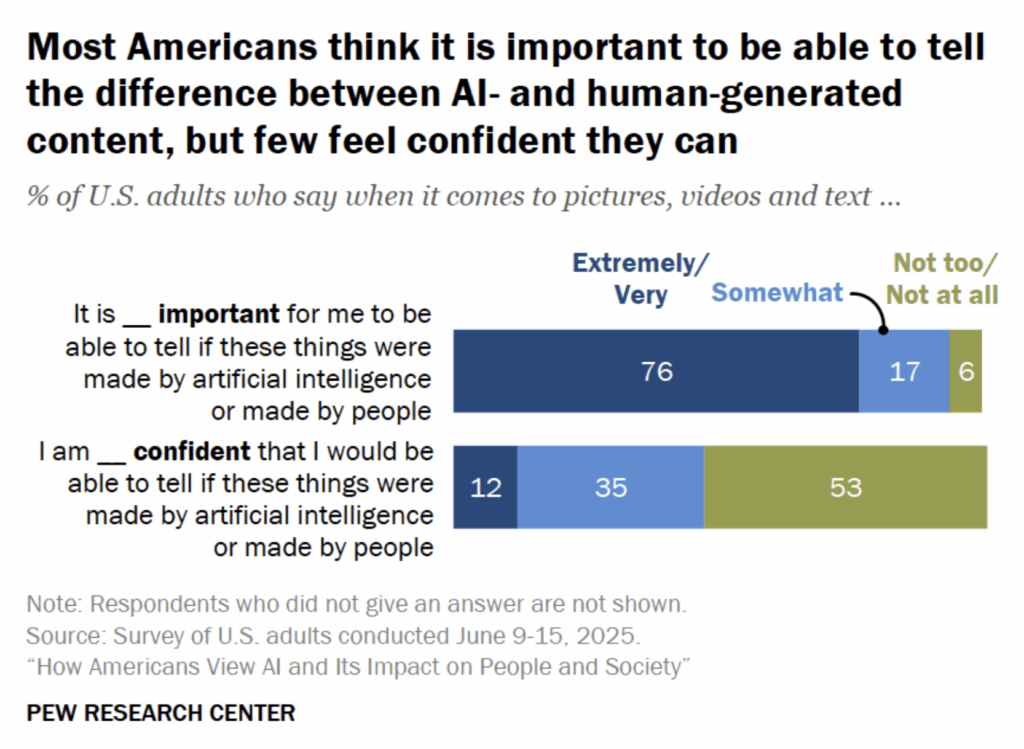

Selon le Pew Research Center, les adultes américains voudraient connaître l’origine d’un contenu, 76% jugent même essentiel que ces contenus soient clairement signalés… mais 53% se disent peu ou pas confiants dans leur capacité à déterminer si une image, une vidéo ou un texte ont été produits par IA.

En pratique, l’étiquetage « Made with AI » reste en effet très insuffisant. Le Washington Post a publié une même vidéo générée par Sora, correctement certifiée via les Content Credentials C2PA, sur huit plateformes : une seule a ajouté un avertissement, discret, enfoui dans la description…

La confiance ne peut plus reposer sur un réflexe visuel, elle doit être reconstruite à travers des preuves, des labels, des explications… que les interfaces actuelles rendent rarement visibles.

Pourtant, des études récentes montrent que dès qu’un contenu est perçu comme potentiellement généré par IA, une partie de l’audience se met instinctivement à distance : baisse de confiance et d’authenticité perçues, moindre connexion émotionnelle.

Une enquête de Raptive menée en 2025 auprès de 3.000 adultes américains montre par exemple que le simple soupçon d’IA suffit à réduire la confiance de 48%, le sentiment d’authenticité de 57% et la connexion émotionnelle de 60% en moyenne.

Pas étonnant dès lors que le « véganisme IA », un mouvement principalement porté par de jeunes utilisateurs qui choisissent de se détourner volontairement de l’intelligence artificielle générative, y compris sur les réseaux sociaux, semble progresser, et pas seulement dans les communautés créatives et étudiantes…

Publicité et modèle économique : quand la défiance devient structurelle

Dans ce climat, l’usage de bloqueurs de publicité progresse également, et nombre d’utilisateurs modifient leurs réglages, leurs choix de plateformes ou leurs habitudes de consommation de contenu.

Les régies publicitaires des plateformes elles-mêmes sont mises en cause. Une enquête de Reuters, fondée sur des documents internes, révèle que Meta a projeté en 2024 que 10% de son chiffre d’affaires annuel (soit environ 16 milliards de dollars) proviendraient de publicités pour des arnaques et des produits interdits.

D’après ces documents:

- les plateformes de Meta afficheraient 15 milliards d’annonces « à haut risque de fraude » par jour (L’Europe veut à présent obliger les réseaux à indemniser les victimes)

- Meta n’interdit un annonceur que si ses systèmes automatisés estiment à 95% la probabilité de fraude

- lorsque cette probabilité est jugée élevée sans franchir ce seuil, l’entreprise applique… un surcoût : les annonceurs suspectés doivent payer plus cher pour gagner les enchères

Au Royaume-Unis, d’après une extrapolation de PressGazette, ces pubs frauduleuses représenteraient plus de 600 millions de livres, soit davantage que le marché publicitaire des médias traditionnels…

Meta conteste certaines interprétations de ces études, mais reconnaît utiliser des « penalty bids » pour renchérir le coût publicitaire des comptes suspects.

Le problème de fond demeure : une partie du modèle économique tire profit de pratiques qui entament la confiance.

Pour contenir la lassitude, Meta remet en avant des mécanismes techniques, comme les contrôles de fréquence, qui permettent de limiter le nombre d’expositions à une même campagne. Mais la réponse ne peut pas être seulement algorithmique…

La confiance comme fracture centrale

D’après le Baromètre des tendances social media publié par Brandwatch, la méfiance touche aussi les annonceurs et les marques, qui soit dit en passant initient moins de 1% des conversations qui les concernent, les 99% restantes se déroulent sans elles (et même souvent contre elles).

Aujourd’hui, 65% des marketeurs se disent désormais préoccupés par la « brand suitability » sur les réseaux sociaux, craignant que leurs publicités ne s’affichent à côté de contenus inappropriés ou toxiques

Sur la base de 910 millions de publications analysées entre 2022 et mi-2025, Brandwatch montre comment ce fossé s’est installé progressivement : promesses publicitaires déçues, expériences client jugées trompeuses, formats jugés intrusifs, opacité tarifaire. La défiance n’est plus un accident, c’est une trajectoire.

Au point qu’aujourd’hui, quelques 54% des conversations liées à la publicité expriment de la colère.

Les internautes dénoncent :

- la surenchère de formats intrusifs

- les pièges à clics (« clickbait »), dont près de 90% des mentions sont négatives

- les abonnements payants qui continuent à afficher des publicités

- la sensation de ne plus avoir la main sur leur expérience de navigation

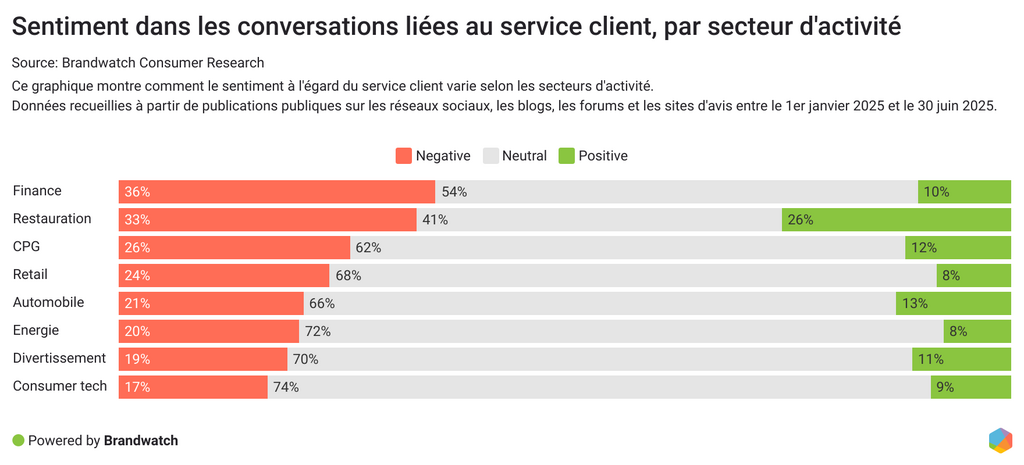

Le sentiment repéré dans les conversations liées au service client sont largement négatives, elles aussi.

Et plusieurs autres signaux tout aussi révélateurs ressortent de cette étude :

- Les mentions de frais cachés et de surcoûts ont augmenté de 40% en 2025, avec 30% de nouveaux intervenants dans ces conversations

- Les mentions de « deinfluencing » (ces contenus où des créateurs et des consommateurs expliquent ce qu’il ne faut PAS acheter) ont bondi de 79%

- Les appels au boycott ont progressé de 95% au premier semestre 2025, et les mentions « do not buy » ont frôlé le million sur six mois

Bref, là où la publicité et la communication étaient censées produire de la confiance, elles sont désormais au cœur de sa crise. Et les consommateurs ne se contentent plus d’ignorer une campagne : ils la contestent, la décortiquent, la ridiculisent, la retournent contre la marque.

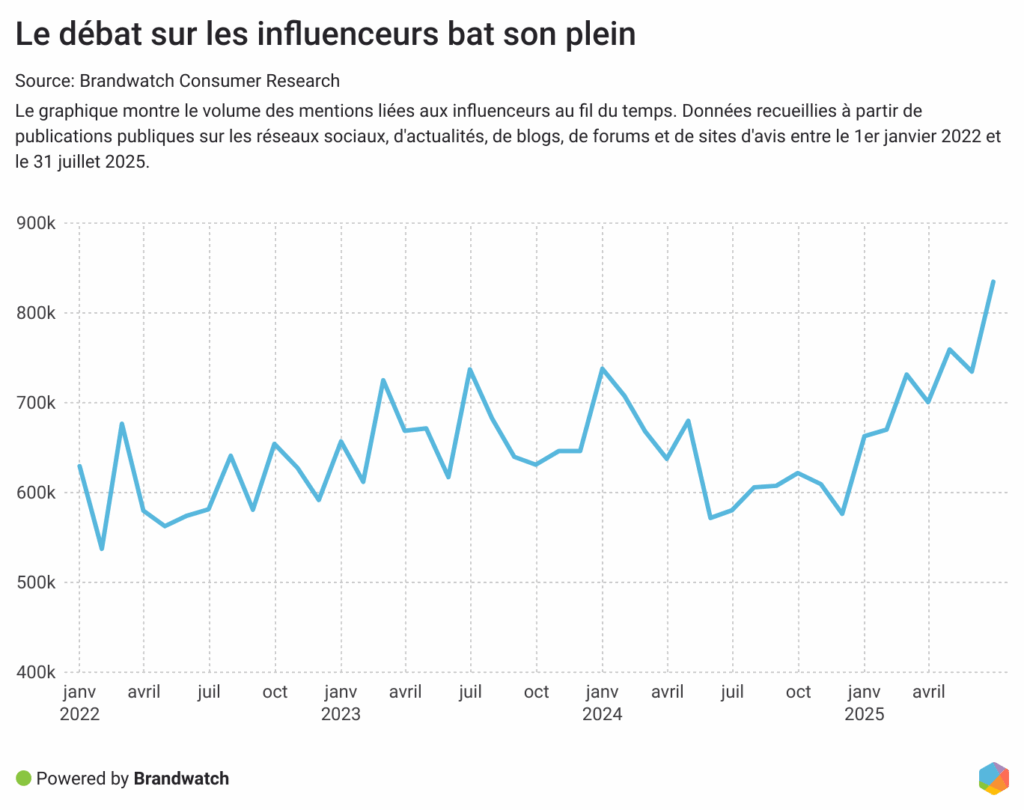

Et les influenceurs, alors ?

Ils sont toujours dans le game, mais le divorce avec les audiences semble consommé.

Alors que le marché du marketing d’influence pèse désormais plus de 24 milliards de dollars, une étude de la Harvard Business Review (HBR) révèle un paradoxe brutal : si les budgets explosent, la confiance, elle, s’effondre. 61% des utilisateurs déclarent avoir perdu confiance dans les recommandations des influenceurs.

L’étude de Brandwatch indique pourtant que 74% des consommateurs ont déjà ajouté un produit à leur panier sur recommandation d’un créateur. L’influence fonctionne donc toujours d’un point de vue transactionnel, mais le lien relationnel se fragilise dangereusement.

Le problème ? Une définition erronée de l’authenticité. Les internautes se détournent des contenus ultra-polissés et des collaborations trop scriptées. Ils ne cherchent plus l’expertise via des diplômes ou des millions d’abonnés, mais via l’expérience vécue : un produit qui ne revient jamais dans les contenus d’un créateur après l’opération sponsorisée est désormais immédiatement catalogué comme suspect.

Dans le même temps, es internautes se détournent progressivement des contenus ultra-polissés, des images et des vidéos dopées à l’IA et des collaborations trop sponsorisées, en particulier dans des secteurs sensibles comme la finance…

Santé mentale et corps : la fatigue comme expérience commune

Les réseaux sociaux ne sont plus perçus seulement comme des espaces ludiques ou informatifs, mais comme une source de fatigue et parfois de détresse.

- Les mentions d’anxiété dans les conversations liant réseaux sociaux et santé mentale ont augmenté de 25%

- Les mentions de « digital detox » (dont les effets sur les plus jeunes sont désormais prouvés) ont progressé de 10% au premier semestre 2025, avec plus de 32.000 nouveaux intervenants

- Les utilisateurs témoignent des bienfaits des périodes de déconnexion : meilleure qualité de sommeil, baisse du stress, meilleure concentration…

Cette « social fatigue » se mesure un peu partout.

Aux États-Unis, une récente étude de l’Association américaine de psychologie (APA) centrée sur la vidéo courte, ajoute que les vidéos courtes ont un effet négatif sur la cognition, un impact « faible » sur la santé mentale, mais pas de lien prouvé entre consommation de vidéos courtes et estime de soi.

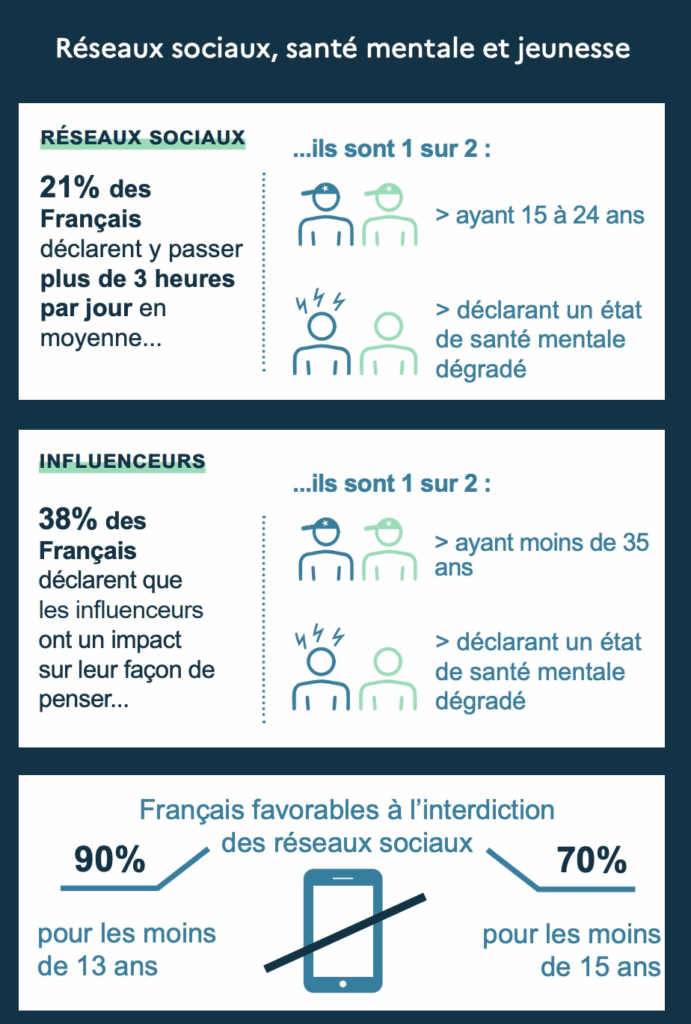

En France, d’après le dernière baromètre MILDECA / Toluna Harris Interactive, l’usage intensif des réseaux sociaux est clairement associé à une santé mentale fragilisée :

Parmi les Français déclarant une santé mentale dégradée :

- 45% déclarent passer plus de 3 heures par jour sur les réseaux sociaux (contre 21% en moyenne)

- 76% estiment y consacrer plus de temps que souhaité

- Les moins de 35 et les Français présentant une santé mentale dégradée se disent davantage influencés par les créateurs de contenus tant s’agissant de leur mode de vie que de leur façon de penser (10 points de plus que la moyenne dans les deux cas)

- 60% des 15-24 ans considèrent que les réseaux sociaux ont un impact négatif sur la société (même si ils sont pourtant 56% à les utiliser plus de 3 heures par jour).

En France toujours, une vaste étude menée par le Pr Nicolas Hoertel estime que l’usage intensif des réseaux sociaux serait associé à près de 600.000 cas supplémentaires de dépression chez les jeunes nés entre 1990 et 2012. Entre 2014 et 2021, la proportion d’adolescents concernés par la dépression serait passée de 2% à 9%, alors que le temps passé sur les réseaux dépassait les deux heures par jour en moyenne.

Pour l’épidémiologiste Martin Blachier, les réseaux sociaux fonctionnent « comme des drogues: ils créent un manque, une angoisse, si bien que le scroll devient le seul moyen de la calmer ».

Le parallèle avec la cigarette s’imposerait : ce qui était présenté comme un symbole de liberté devient un produit hautement addictif. Notifications, likes, vidéos en boucle: chaque micro-stimulation déclenche une dose de dopamine qui rend la déconnexion difficile, avec à la clé troubles de l’attention, saturation mentale et épuisement émotionnel.

L’étude ne prouve pas une causalité simple, mais ses projections sont parlantes : limiter l’usage des réseaux à une heure par jour pourrait réduire de près de 15% la proportion de jeunes touchés par la dépression, et remplacer 30 minutes de scroll par 30 minutes d’activité physique entraînerait une baisse de 13%. La confiance ne se joue donc plus seulement au niveau des contenus, mais au niveau des routines de vie et des politiques de prévention.

La résistance s’organise (un peu)

Alors que Meta semble avoir volontairement ignoré depuis 2019 les conséquences de l’usage de ses plateformes sur la santé mentale de ses utilisateurs, la résistance semble s’organiser, collectivement et individuellement.

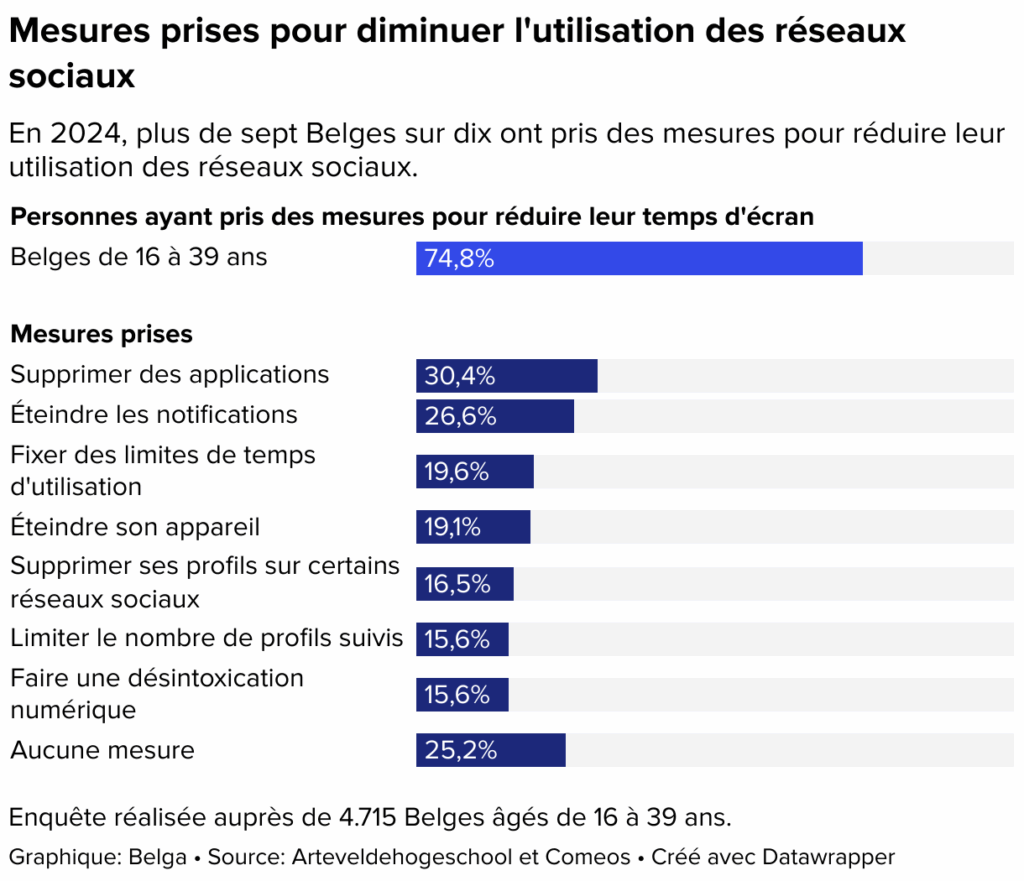

En Belgique, par exemple, un récent rapport sur les réseaux sociaux note que les 16-24 ans prennent des mesures concrètes : suppression d’applications, désactivation de notifications, réduction volontaire de certaines utilisations…

Régulation… insuffisante

La régulation, elle, se durcit. La Commission européenne discute de nouvelles restrictions pour les moins de 16 ans, tandis qu’en Australie une loi impose dès décembre 2025 aux plateformes d’empêcher les moins de 16 ans d’utiliser leurs services (la Malaysie veut suivre), avec désactivation progressive des comptes. Mais les marges d’erreur dans la vérification d’âge, l’absence de standard commun et les risques autour de la collecte de documents d’identité entretiennent un sentiment de bricolage réglementaire.

Pour autant, faire « tout couper » serait une fausse solution. Les réseaux sociaux restent des espaces où des jeunes trouvent une voix, une communauté, un soutien ou un terrain d’expression.

La chercheuse Anne Cordier alerte sur le risque d’une dérive autoritaire : « Avec une telle interdiction, les jeunes deviennent une population à contrôler plutôt qu’à éduquer« .

La confiance avec les mineurs se jouera moins dans l’interdiction globale que dans un mix réaliste: retarder l’exposition quand c’est possible, apprendre à se limiter, comprendre les mécanismes d’addiction, et faire des réseaux un outil d’émancipation plutôt qu’un simple distributeur de dopamine.

Environnement: la confiance entamée par le coût carbone

À cette fatigue psychique s’ajoute un scrupule plus récent : l’impact environnemental.

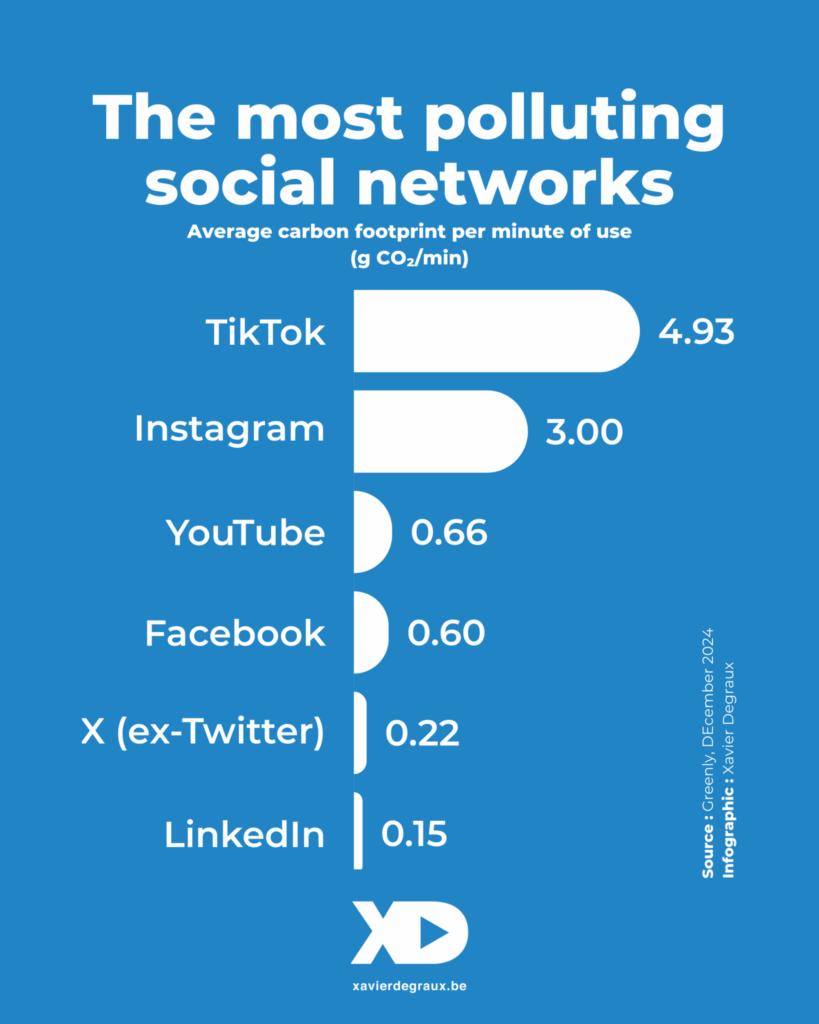

Une étude menée par Greenly évalue l’empreinte carbone moyenne d’une minute passée sur différentes plateformes.

Un utilisateur moyen de TikTok, avec plus de 1.200 minutes par mois, générerait ainsi environ 6 kg de CO₂ chaque mois, soit l’équivalent de plusieurs dizaines de kilomètres en voiture thermique.

L’accélération de l’IA (slop), très gourmande en calculs, accentue encore ce débat : des rapports relèvent les inquiétudes sur la consommation énergétique des centres de données et sur l’empreinte carbone de l’intelligence artificielle appliquée aux flux sociaux.

La confiance ne se joue plus seulement sur « ce que les plateformes font de nous », mais aussi sur « ce qu’elles font du monde » au sens le plus concret.

Peut-on reconstruire la confiance?

Rien n’indique que les réseaux sociaux s’effondreront demain.

Bien qu’en léger recul au niveau mondial, le temps qui y est consacré reste élevé, les usages se renouvellent, de nouvelles plateformes plus ou moins saines apparaissent, comme l’Européen Monnet, et d’autres réapparaissent, comme DiVine.

Mais tout indique que la confiance ne reviendra pas spontanément.

Plusieurs pistes se dégagent néanmoins des études que nous avons lues ces derniers mois. Notamment celle de la Harvard Business Review qui rappelle que l’authenticité n’est pas un trait de caractère figé, mais une co-construction qui repose sur 5 piliers précis :

- L’Expertise : On ne croit plus aux statuts, mais à la cohérence. L’audience fait plus confiance à un amateur qui documente sa progression réelle qu’à une star parachutée sur un sujet qu’elle ne maîtrise pas.

- La Connexion : Passer de la diffusion (broadcasting) à la conversation réelle (répondre aux commentaires, créer du lien).

- L’Intégrité : L’audience accepte la motivation financière (sponsoring), à condition qu’elle soit transparente et ne dicte pas le discours.

- L’Originalité : C’est la fin des scripts dictés par les marques. La « storytelling freedom » est impérative pour ne pas sonner faux.

- La Transparence : Admettre les défauts d’un produit ou montrer les coulisses renforce paradoxalement la crédibilité du message.

Au-delà de ces postures, les plateformes et les marques doivent aussi agir structurellement :

- Rendre visibles les preuves : origine des contenus, métadonnées, labels C2PA, sources primaires, contexte explicite

- Assumer les corrections : reconnaître les erreurs, corriger publiquement, archiver les versions, expliquer les changements

- Clarifier la pub : signaler clairement le caractère commercial, bannir les formats trompeurs, éliminer les frais cachés, respecter les promesses de « sans pub »

- Rééquilibrer les algorithmes : intégrer des objectifs de qualité, de pluralité, de bien-être, pas seulement d’engagement brut

- Traiter les arnaques comme un enjeu systémique : vérifier mieux les annonceurs, coopérer avec les autorités, accepter que la perte de revenus frauduleux est le prix de la crédibilité

- Aligner IA et humain : utiliser l’IA pour accélérer le service, pas pour masquer l’absence de responsabilité humaine

- Intégrer l’environnement : prendre au sérieux l’empreinte carbone, optimiser les formats, rendre publics les engagements énergétiques

Longtemps portés par une promesse implicite de lien et de liberté, les réseaux sociaux sont désormais sommés de montrer comment ils traitent leurs contenus, leurs utilisateurs, leurs données (coucou Whatsapp), leurs annonceurs… et leurs externalités.

Une vingtaine d’années après leur naissance, la confiance à leur égard ne sera plus jamais gratuite. Elle devra être prouvée, vérifiable, corrigible. C’est là tout l’enjeu des prochains mois. En particulier en Europe, à la pointe de la régulation… sur papier en tout cas.

Xavier Degraux ► Stratège LinkedIn™, Employee Advocacy & Social Selling ► Je transforme Marques, Comex & Dirigeants en Médias (Autorité) ► Thought Leadership Data-Driven & IA ► Ex-Journaliste Éco

Découvrez les 7 tendances sur les réseaux sociaux en 2025-2026

- Introduction : Les 7 tendances des réseaux sociaux en 2025-2026

- Les réseaux sociaux ne sont plus vraiment sociaux (1/7)

- Passive scrolling et bascule des conversations en privé (2/7)

- Des fils saturés d’IA et de contenus ultra-transformés (3/7)

- Quand les réseaux sociaux deviennent assistants IA et moteurs de recherche (4/7)

- La vidéo courte règne, mais la longue convertit (5/7)

- Portée organique en chute: place au pay-to-play pour tous ? (6/7)

- Réseaux sociaux: la confiance s’érode encore (7/7)

- Conclusion : Les 7 tendances des réseaux sociaux en 2025-2026 (synthèse exécutive)